ITж—¶жҠҘ|еҢ—йӮ®еј еӢҮпјҡ5G+AIд»Қжңүдә”еӨ§жҢ‘жҲҳ

жң¬ж–ҮжҸ’еӣҫ

30з§’еҝ«иҜ»

1

вҖңдәәе·ҘжҷәиғҪеҸ‘еұ•йҒ“и·ҜиҝҳеҫҲжј«й•ҝ пјҢ й’ҲеҜ№дәәе·ҘжҷәиғҪе’ҢйҖҡдҝЎзҪ‘з»ңзҡ„з»“еҗҲ пјҢ жҲ‘们йңҖиҰҒеҒҡеҘҪеҗ„з§ҚеҮҶеӨҮ гҖӮ вҖқеңЁ7жңҲ10ж—Ҙ2020дё–з•Ңдәәе·ҘжҷәиғҪеӨ§дјҡдә‘з«Ҝеі°дјҡзҡ„вҖңAIж–°еҹәе»ә 5Gж–°жңәйҒҮвҖқдё»йўҳи®әеқӣдёӯ пјҢ еҢ—дә¬йӮ®з”өеӨ§еӯҰж•ҷжҺҲеј еӢҮиЎЁзӨә пјҢ еңЁз”өдҝЎиҝҗиҗҘе•ҶзҪ‘з»ңжҷәиғҪеҢ–ж–№йқў пјҢ ж·ұеәҰзҘһз»ҸзҪ‘з»ңе·Із»ҸжҲҗдёәдё»жөҒж–№жЎҲ пјҢ дҪҶд»–еҗҢж—¶жҢҮеҮә пјҢ е®үе…Ёй—®йўҳдҪҝеҫ—AIеңЁйҖҡдҝЎзҪ‘з»ңеә”з”Ёж—¶еҫҲйҡҫеҫ—еҲ°дҝЎд»» гҖӮ

2

вҖңеҪ“еүҚе·Із»ҸеҮәзҺ°дёҖдәӣвҖҷж•°жҚ®жҠ•жҜ’вҖҷвҖҷйҖғйҖёж”»еҮ»вҖҷзӯүдё“й—Ёж”»еҮ»AIзі»з»ҹзҡ„жүӢж®ө гҖӮ вҖқд»–ејәи°ғ гҖӮ еңЁиҮӘеҠЁй©ҫ驶йўҶеҹҹ пјҢ вҖңж•°жҚ®жҠ•жҜ’вҖқеҸҜеҜјиҮҙиҪҰиҫҶиҝқеҸҚдәӨйҖҡ规еҲҷз”ҡиҮійҖ жҲҗдәӨйҖҡдәӢж•…пјӣеңЁеҶӣдәӢйўҶеҹҹ пјҢ йҖҡиҝҮдҝЎжҒҜдјӘиЈ…зҡ„ж–№ејҸеҸҜиҜұеҜјиҮӘдё»жҖ§жӯҰеҷЁеҗҜеҠЁжҲ–ж”»еҮ» пјҢ е…¶еёҰжқҘзҡ„йЈҺйҷ©жҳҜжҜҒзҒӯжҖ§зҡ„ гҖӮ

еј еӢҮжҸҗеҮәAIеңЁ5GзҪ‘з»ңжҷәиғҪеҢ–еә”з”Ёдёӯйқўдёҙзҡ„дә”еӨ§жҢ‘жҲҳ гҖӮ

жҢ‘жҲҳдёҖ

еқҸж•°жҚ®дјҡдә§з”ҹвҖңеҒҸи§ҒвҖқ

ж•°жҚ®гҖҒз®—еҠӣгҖҒз®—жі• пјҢ ж·ұеәҰеӯҰд№ дёүеӨ§е…ій”®иҜҚ пјҢ е…¶дёӯж•°жҚ®еҫҖеҫҖиў«и®ӨдёәжҳҜдәәе·ҘжҷәиғҪжңҖйҮҚиҰҒзҡ„й©ұеҠЁеҠӣ пјҢ дҪҶд№ҹжӯЈеӣ еҰӮжӯӨ пјҢ вҖңеқҸвҖқзҡ„ж•°жҚ® пјҢ жҲ–иҖ…вҖңдёҚе®Ңе–„вҖқзҡ„ж•°жҚ® пјҢ дјҡзӣҙжҺҘеҪұе“Қи®Ўз®—з»“жһң гҖӮ дёҚд№…еүҚ пјҢ зҫҺеӣҪжқңе…ӢеӨ§еӯҰз ”з©¶дәәе‘ҳеҸ‘жҳҺдёҖз§Қж–°зҡ„еӣҫеғҸиҜҶеҲ«з®—жі•PULSE пјҢ е®ғеҸҜд»Ҙе°ҶдҪҺеҲҶиҫЁеӣҫзүҮеҸҳжҲҗй«ҳжё…еӣҫзүҮ пјҢ дҪҶжңүдәәе°ҶеҘҘе·ҙ马жү“дәҶ马иөӣе…Ӣзҡ„з…§зүҮиҫ“е…ҘеҗҺ пјҢ еӨҚеҺҹзҡ„з…§зүҮеҚҙжңүдәҶзҷҪдәәзҡ„зү№еҫҒ гҖӮ еӣҫзҒөеҘ–еҫ—дё»гҖҒдәәе·ҘжҷәиғҪж ҮжқҶжҖ§дәәзү© Yann LeCunи®Өдёә пјҢ иҝҷдёҚд»…жҳҜз®—жі•зҡ„й—®йўҳ пјҢ иҖҢжҳҜи®ӯз»ғж—¶дҪҝз”Ёзҡ„ж•°жҚ®дә§з”ҹдәҶвҖңеҒҸи§ҒвҖқ гҖӮ

жң¬ж–ҮжҸ’еӣҫ

еӣҫжәҗ/зҪ‘з»ң

вҖңж•°жҚ®дёҚе®Ңе–„ пјҢ дёҚз®ЎжҳҜж•°жҚ®жәҗж•°йҮҸ пјҢ иҝҳжҳҜе·Іжңүж•°жҚ®зҡ„жҢҮж Үж·ұеәҰйғҪеӯҳеңЁзқҖдёҚи¶і пјҢ дҪҝз”Ёиҝҷдәӣж•°жҚ®еә”з”ЁжҷәиғҪиҝҗз»ҙж•ҲжһңдёҚдҪі пјҢ з”ҡиҮідјҡйҖ жҲҗеҶізӯ–й”ҷиҜҜ гҖӮ вҖқеј еӢҮи®Өдёә пјҢ еҪ“еүҚеӯҳеңЁж Үи®°ж•°жҚ®зјәд№ҸгҖҒж•°жҚ®дёҚе№іиЎЎ/ејӮеёёж ҮжіЁе№ҝжіӣеӯҳеңЁгҖҒд»ҝзңҹж•°жҚ®йҡҫд»ҘдҪҝдәәдҝЎжңҚзӯүж•°жҚ®жәҗй—®йўҳ пјҢ иҝҷдәӣйғҪдјҡеҪұе“ҚAIеҜ№жҷәиғҪйҖҡдҝЎзҪ‘з»ңзҡ„дјҳеҢ– гҖӮ

жҢ‘жҲҳдәҢ

зӣ®еүҚзҡ„AIиғҪеҠӣиҝҳеҫҲвҖңзҫёејұвҖқ

вҖңйҖҡдҝЎзҪ‘з»ңеҜ№еҸҜйқ жҖ§зЁіе®ҡжҖ§зҡ„иҰҒжұӮ пјҢ иҝңжҜ”и®Ўз®—жңәе®ҢжҲҗдәәи„ёиҜҶеҲ«гҖҒиҜӯйҹіиҜҶеҲ«зҡ„иҰҒжұӮиҰҒй«ҳ гҖӮ вҖқиҷҪ然AIеңЁиҜӯйҹігҖҒи§Ҷйў‘гҖҒеӣҫеғҸгҖҒж–Үжң¬зӯүйўҶеҹҹе·Із»ҸиҺ·еҫ—еј•дәәжіЁзӣ®зҡ„жҲҗе°ұ пјҢ дҪҶеә”з”ЁеҲ°зҪ‘з»ңйҖҡдҝЎж–№йқўиҝҳеӯҳеңЁзқҖеӨ§йҮҸеӣ°йҡҫ пјҢ еј еӢҮдёҫдәҶдёҖдёӘдҫӢеӯҗ пјҢ з ”з©¶еӣўйҳҹеңЁйҖҡиҝҮеҜ№зҪ‘з»ңжөҒйҮҸж•°жҚ®иҝӣиЎҢзҪ‘з»ңж”»еҮ»иЎҢдёәжЈҖжөӢ пјҢ еңЁдёҖдёӘе…¬ејҖж•°жҚ®йӣҶдёҠиҝӣиЎҢеҲҶзұ»жЈҖжөӢеҫ—еҲ°дёҖдёӘеҫҲеҘҪзҡ„жЁЎеһӢ гҖӮ жҚўдёҖдёӘж•°жҚ®йӣҶ пјҢ еҗҢж ·еҢ…еҗ«дёҖж ·зҡ„ж”»еҮ»иЎҢдёә пјҢ жЈҖжөӢж•Ҳжһңе°ұйқһеёёе·® гҖӮ

жң¬ж–ҮжҸ’еӣҫ

еӣҫжәҗ/Pixabay

вҖңзӣ®еүҚзҡ„AIиҝҳжҳҜдёҖз§Қејұдәәе·ҘжҷәиғҪйҳ¶ж®ө пјҢ йңҖиҰҒиҖ—иҙ№еӨ§йҮҸзҡ„и®Ўз®—иө„жәҗ пјҢ жүҚеҸҜд»ҘиҺ·еҫ—дёҖдёӘдәәзұ»еҫҲе®№жҳ“жӢҘжңүзҡ„иғҪеҠӣ гҖӮ вҖқжӯӨеӨ– пјҢ еј еӢҮиҝҳжҢҮеҮә пјҢ AIзјәд№ҸйҖ»иҫ‘жҺЁзҗҶиғҪеҠӣ пјҢ йӮЈд№ҲеңЁзҪ‘з»ңжҷәиғҪиҝҗз»ҙдёҠжүҖйңҖиҰҒзҡ„дёҖдәӣйҖ»иҫ‘жҺЁзҗҶй—®йўҳжІЎжңүеҠһжі•ејҖеұ• пјҢ иҖҢдё”еҗ„з§ҚжЁЎеһӢж— жі•дә’йҖҡ пјҢ иҺ·еҫ—зҡ„зҹҘиҜҶд№ҹж— жі•дј йҖ’ гҖӮ

жҢ‘жҲҳдёү

вҖңй»‘зӣ’еӯҗвҖқж— жі•иҺ·еҫ—дҝЎд»»

вҖңй»‘зӣ’еӯҗвҖқжҳҜеҪ“еүҚж·ұеәҰеӯҰд№ дә§дёҡеҢ–жңҖеӨ§зҡ„жӢҰи·ҜиҷҺ гҖӮ з”ұдәҺзјәд№Ҹж•°зҗҶеҹәзЎҖзҡ„ж”Ҝж’‘ пјҢ AIжЁЎеһӢзҡ„еҘҪеқҸд»ҘеҸҠеҺҹеӣ пјҢ йҖҡеёёйғҪжҳҜдёӘвҖңи°ңвҖқ гҖӮ еӣ жӯӨ пјҢ еңЁйңҖиҰҒй«ҳеҸҜйқ жҖ§зҡ„йҖҡдҝЎзҪ‘з»ңеңәжҷҜдёӯ пјҢ AIеҫҖеҫҖеҫ—дёҚеҲ°дҝЎд»» гҖӮ

жң¬ж–ҮжҸ’еӣҫ

еӣҫжәҗ/Pixabay

еј еӢҮеӣўйҳҹеңЁе’ҢдёҖдәӣдјҒдёҡеҗҲдҪңж—¶ пјҢ еҮҶеӨҮз”ЁAIжҠҖжңҜеҒҡж— зәҝдҝЎеҸ·иҜҶеҲ« пјҢ еҜ№ж–№дҫҝжҸҗеҮә пјҢ иғҪдёҚиғҪдёҚиҰҒз”Ёж·ұеәҰеӯҰд№ пјҢ вҖңеӣ дёәж„ҹи§үиҝҷдёӘдёҚжҳҜеҫҲеҸҜйқ гҖӮ вҖқиҝҷдёәAIжҠҖжңҜеңЁзҪ‘з»ңжҷәиғҪеҢ–еә”з”ЁеёҰжқҘжҢ‘жҲҳпјҡж·ұеәҰеӯҰд№ еҰӮдҪ•еңЁзҪ‘з»ңжҷәиғҪеҢ–дёҠйқўдҝқжҢҒдҝқиҜҒй«ҳеәҰеҸҜйқ жҖ§ пјҢ еҰӮдҪ•иҜҙжңҚдҪҝз”ЁиҖ…дҝЎд»»е®ғпјҹ

жҢ‘жҲҳеӣӣ

еҠЁжҖҒиө„жәҗеҲҶй…ҚеҸҜиғҪеҜ№зҪ‘з»ңдә§з”ҹеҪұе“Қ

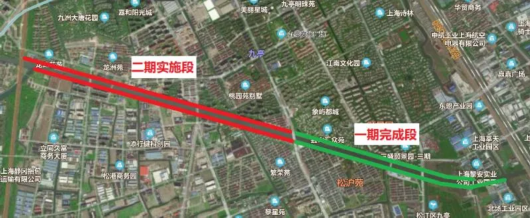

еҲҡеҲҡдәҺеҢ—дә¬ж—¶й—ҙ7жңҲ3ж—ҘжҷҡеҶ»з»“зҡ„第дёҖдёӘ5Gжј”иҝӣзүҲж ҮеҮҶR16 пјҢ еҶҚж¬ЎжҠҠзҪ‘з»ңиҮӘеҠЁеҢ–жҸҗдёҠж—ҘзЁӢ гҖӮ дёәдәҶе®һзҺ°зҪ‘з»ңиҮӘеҠЁеҢ–е’ҢжҷәиғҪеҢ– пјҢ еӣҪйҷ…ж ҮеҮҶз»„з»Ү3GPPе®ҡд№үдәҶ5GзҪ‘з»ңиҮӘеҠЁеҢ–зҡ„йҖҡз”Ёжһ¶жһ„ пјҢ ж–°еўһдәҶзҪ‘з»ңж•°жҚ®еҲҶжһҗеҠҹиғҪ пјҢ дҪңдёәеӨ§ж•°жҚ®ж”¶йӣҶе’ҢжҷәиғҪеҲҶжһҗзҡ„жүҝиҪҪе®һдҪ“ пјҢ дёҚд»…иғҪ收йӣҶж•°жҚ® пјҢ иҝҳе…·еӨҮжҷәиғҪеҲҶжһҗзҡ„иғҪеҠӣ пјҢ еҢ…жӢ¬и®Ўз®—жЁЎеһӢи®ӯз»ғгҖҒжҺЁзҗҶеҲӨж–ӯдёҺйў„жөӢзӯүзӯү гҖӮ

жң¬ж–ҮжҸ’еӣҫ

еӣҫжәҗ/зҪ‘з»ң

еӣ жӯӨ пјҢ еңЁеҫҲеӨҡеҜ№жңӘжқҘ5GзӨҫдјҡзҡ„и®ҫжғідёӯ пјҢ дҪҝз”ЁиҖ…еҸҜд»ҘжҢүйңҖеҲҶй…ҚгҖҒжҢүйңҖдҪҝз”ЁгҖҒжҢүйңҖи®Ўиҙ№ пјҢ иҝҷдёӘиҰҒжұӮеҝ…然еҸӘиғҪйҖҡиҝҮAIжқҘе®ҢжҲҗ гҖӮ дҪҶзҺ°е®һжғ…еҶөжҳҜ пјҢ зҺ°жңүзҪ‘з»ңеңәжҷҜиҝңжҜ”ж•°еӯҰжЁЎеһӢеңәжҷҜеӨҚжқӮ пјҢ зӣ®еүҚзҪ‘з»ңиө„жәҗеҲҶй…ҚеӨ§еӨҡдҪҝз”ЁејәеҢ–еӯҰд№ ж–№жі• пјҢ еј еӢҮжҢҮеҮә пјҢ еңЁејәеҢ–еӯҰд№ зҡ„жҺўзҙўиҝҮзЁӢдёӯй—ҙ пјҢ еҰӮжһңеңЁзҺ°зҪ‘дёҠзӣҙжҺҘжөӢиҜ• пјҢ еҫҲе®№жҳ“еҜ№зҪ‘з»ңжҖ§иғҪеёҰжқҘиҙҹйқўеҪұе“Қ гҖӮ

дәҺжҳҜ пјҢ з ”з©¶иҖ…йҒӯйҒҮдёӨйҡҫпјҡеҰӮжһңе…ҲеңЁжөӢиҜ•зҪ‘з»ңдёҠејҖеұ•е·ҘдҪң пјҢ жғіиҰҒеҫ—еҲ°еҘҪзҡ„з»“жһң пјҢ йңҖиҰҒжҸҗеүҚеҒҡеӨ§йҮҸе®һйӘҢ пјҢ дҪҶйҖҡдҝЎеңәжҷҜд№ӢеӨҡж ·жҖ§иҝңи¶…и°·жӯҢAlphaGo ZeroйҒҮеҲ°зҡ„жғ…еҶө пјҢ и®ӯз»ғиҝҮзЁӢдёӯйңҖиҰҒзҡ„иө„жәҗгҖҒж•°жҚ®йҮҸе’Ңи®Ўз®—йҮҸдёҚеҸҜжғіеғҸ пјҢ д№ҹж— жі•жүҝеҸ— гҖӮ

жҢ‘жҲҳдә”

е°Ҹеҝғж·ұеәҰеӯҰд№ иў«з”ЁжқҘвҖңеҜ№жҠ—ж”»еҮ»вҖқ

ж·ұеәҰеӯҰд№ еҜ№дә§дёҡеҸ‘еұ•еёҰжқҘжңәйҒҮ пјҢ 并ж—ҘзӣҠжҷ®еҸҠ пјҢ дҪҶд№ҹдҪҝеҫ—е®үе…Ёй—®йўҳиў«жҸҗдёҠдәҶи®®дәӢж—ҘзЁӢ гҖӮ жңүз ”з©¶иЎЁжҳҺ пјҢ ж·ұеәҰзҘһз»ҸзҪ‘дёәзҪ‘з»ңе®үе…ЁеёҰжқҘи·Ёи¶ҠејҸзҡ„еҸ‘еұ•жңәйҒҮ пјҢ дҪҶд№ҹдёәж”»еҮ»иҖ…жҸҗдҫӣдәҶж–°зҡ„ж”»еҮ»йқўвҖ”вҖ”й’ҲеҜ№AIжЁЎеһӢе®Ңж•ҙеһӢеҸ‘иө·зҡ„ж”»еҮ» пјҢ еҚіжүҖи°“зҡ„вҖңеҜ№жҠ—ж”»еҮ»вҖқ гҖӮ

вҖңж•°жҚ®жҠ•жҜ’вҖқе’ҢвҖңйҖғйҖёж”»еҮ»вҖқжҳҜдёӨз§Қеёёи§Ғзҡ„еҜ№жҠ—ж”»еҮ» гҖӮ вҖңж•°жҚ®жҠ•жҜ’вҖқжҳҜжҢҮж”»еҮ»иҖ…йҖҡиҝҮеңЁи®ӯз»ғж•°жҚ®йҮҢеҠ е…ҘдјӘиЈ…ж•°жҚ®гҖҒжҒ¶ж„Ҹж ·жң¬зӯүиЎҢдёәжқҘз ҙеқҸж•°жҚ®зҡ„е®Ңж•ҙжҖ§ пјҢ иҝӣиҖҢеҜјиҮҙи®ӯз»ғзҡ„з®—жі•жЁЎеһӢеҶізӯ–еҮәзҺ°еҒҸе·® гҖӮ

ж №жҚ®дёӯеӣҪдҝЎйҖҡйҷўеҸ‘еёғзҡ„гҖҠдәәе·ҘжҷәиғҪж•°жҚ®е®үе…ЁзҷҪзҡ®д№ҰпјҲ2019пјүгҖӢ пјҢ вҖңж•°жҚ®жҠ•жҜ’вҖқеҚұе®іе·ЁеӨ§ гҖӮ еңЁиҮӘеҠЁй©ҫ驶йўҶеҹҹ пјҢ вҖңж•°жҚ®жҠ•жҜ’вҖқеҸҜеҜјиҮҙиҪҰиҫҶиҝқеҸҚдәӨйҖҡ规еҲҷз”ҡиҮійҖ жҲҗдәӨйҖҡдәӢж•…пјӣеңЁеҶӣдәӢйўҶеҹҹ пјҢ йҖҡиҝҮдҝЎжҒҜдјӘиЈ…зҡ„ж–№ејҸеҸҜиҜұеҜјиҮӘдё»жҖ§жӯҰеҷЁеҗҜеҠЁжҲ–ж”»еҮ» пјҢ д»ҺиҖҢеёҰжқҘжҜҒзҒӯжҖ§йЈҺйҷ© гҖӮ

жң¬ж–ҮжҸ’еӣҫ

еӣҫжәҗ/дёӯеӣҪдҝЎйҖҡйҷў

йҖғйҖёж”»еҮ»еҲҷжҳҜжҢҮж”»еҮ»иҖ…еңЁдёҚж”№еҸҳзӣ®ж ҮжңәеҷЁеӯҰд№ зі»з»ҹзҡ„жғ…еҶөдёӢ пјҢ йҖҡиҝҮжһ„йҖ зү№е®ҡиҫ“е…Ҙж ·жң¬д»Ҙе®ҢжҲҗж¬әйӘ—зӣ®ж Үзі»з»ҹзҡ„ж”»еҮ» гҖӮ жҜ”еҰӮ пјҢ дёҖдёӘж·ұеәҰеӯҰд№ зі»з»ҹеҺҹжң¬еҸҜд»ҘзІҫзЎ®еҢәеҲҶзҶҠзҢ«дёҺй•ҝиҮӮзҢҝзӯүеӣҫзүҮ пјҢ дҪҶжҳҜж”»еҮ»иҖ…еҸҜд»ҘеҜ№зҶҠзҢ«еӣҫзүҮеўһеҠ е°‘йҮҸе№Іжү° пјҢ з”ҹжҲҗзҡ„еӣҫзүҮ пјҢ дәәзңӢиө·жқҘд»ҚжҳҜзҶҠзҢ« пјҢ дҪҶзі»з»ҹдјҡиҜҜи®Өдёәй•ҝиҮӮзҢҝ гҖӮ

е“ӘжҖ•жҳҜд»Ҡе№ҙжңҖзғӯй—Ёзҡ„иҒ”йӮҰеӯҰд№ пјҢ д№ҹеҸҜиғҪеӯҳеңЁжҒ¶ж„ҸеҸӮдёҺиҖ… пјҢ еҰӮжһңеңЁеҺҹе§Ӣж ·жң¬дёӯеҠ е…Ҙе°Ҹе№…еәҰзҡ„жү°еҠЁ пјҢ дҫҝеҸҜиғҪдҪҝз”ҹжҲҗеҜ№жҠ—ж”»еҮ»ж—¶зҡ„ејӮеёёжЈҖжөӢзі»з»ҹеҸ‘з”ҹиҜҜеҲӨ гҖӮ

еј еӢҮеӣўйҳҹеҒҡдәҶдёҖдёӘе®һйӘҢ пјҢ й’ҲеҜ№еҹәдәҺAIзҡ„е…ҘдҫөжЈҖжөӢзі»з»ҹ пјҢ йҖҡиҝҮеҜ№жҠ—з”ҹжҲҗзҪ‘з»ңдә§з”ҹж”»еҮ»зҡ„зҪ‘з»ңж•°жҚ®жөҒж ·жң¬ пјҢ еҜ№йҮҮз”ЁдёҚеҗҢжңәеҷЁеӯҰд№ з®—жі•зҡ„IDSпјҲе…ҘдҫөжЈҖжөӢзі»з»ҹпјүиҝӣиЎҢж”»еҮ» пјҢ ж”»еҮ»жҲҗеҠҹзҺҮжңҖй«ҳеҸҜд»ҘиҫҫеҲ°80%д»ҘдёҠ пјҢ д№ҹе°ұжҳҜиҜҙ пјҢ 他们改еҸҳдәҶж”»еҮ»ж•°жҚ®зә§зҡ„зү№еҫҒ пјҢ и®©еҺҹжң¬е…·жңүеҫҲй«ҳжЈҖжөӢиғҪеҠӣзҡ„еҹәдәҺAIзҡ„е…ҘдҫөжЈҖжөӢзі»з»ҹеӨұж•ҲдәҶ гҖӮ

вҖңжһ„е»әдёҖдёӘеҸҜйқ гҖҒе®үе…ЁгҖҒеҸҜдҝЎзҡ„дәәе·ҘжҷәиғҪи§ЈеҶіж–№жЎҲ пјҢ йңҖиҰҒд»Һж•°зҗҶеҹәзЎҖдёҠиҝӣиЎҢжўізҗҶз ”з©¶ пјҢ дҪҶиҝҷжҳҜдёҖдёӘеҫҲжј«й•ҝзҡ„е·ҘдҪң пјҢ зӣ®еүҚжқҘзңӢиҝҳжІЎжңүеҘҪзҡ„ж–№жі• гҖӮ вҖқеј еӢҮиЎЁзӨә гҖӮ

жң¬ж–ҮжҸ’еӣҫ

гҖҗITж—¶жҠҘ|еҢ—йӮ®еј еӢҮпјҡ5G+AIд»Қжңүдә”еӨ§жҢ‘жҲҳгҖ‘ дҪ еҜ№AIзҡ„дҝЎд»»еҚұжңәжҖҺд№ҲзңӢпјҹ

жҺЁиҚҗйҳ…иҜ»

- зҺҜзҗғж—¶жҠҘ|马е…Ӣйҫҷе‘јеҗҒ欧зӣҹж”ҜжҢҒзҷҪдҝ„зҪ—ж–ҜеҸҚж”ҝеәңзӨәеЁҒпјҢдҝ„ж–№пјҡиҷҡдјӘ

- зҺҜзҗғж—¶жҠҘ|еҚ°еәҰеҗ‘дёӯеҚ°иҫ№еўғең°еҢәеўһе…ө20дёҮпјҢеҚ°еӘ’пјҡдёҚеҘҪвҖҰвҖҰ

- зҺҜзҗғж—¶жҠҘ|дёӯеӣҪдә§вҖңжңәеҷЁдәәжҠӨеЈ«вҖқеңЁиҘҝзҸӯзүҷеҢ»йҷўдёҠеІ—

- зҺҜзҗғж—¶жҠҘ|еҪ“еҝғпјҒзҫҺеӘ’е·Із»ҸејҖе§Ӣй»‘дёӯеӣҪж–°еҶ з–«иӢ—дәҶ

- зҺҜзҗғж—¶жҠҘ|йҒҝе…ҚйҮҚи№Ҳй»Һе·ҙе«©иҰҶиҫҷпјҢеӨҡеӣҪжёҜеҸЈзҙ§жҖҘжё…зҗҶеҚұйҷ©еҢ–еӯҰзү©

- зҺҜзҗғж—¶жҠҘ|马е…ӢйҫҷжҢәзҷҪдҝ„зҪ—ж–ҜеҸҚж”ҝеәңзӨәеЁҒ иҺ«ж–Ҝ科жү№жі•еӣҪдәәиҷҡдјӘ

- зҺҜзҗғж—¶жҠҘ|еҚ·е…ҘдёӨе…ҡдәүж–—пјҢи„ёд№ҰеңЁеҚ°еәҰй—№еҫ—вҖңйҮҢеӨ–дёҚжҳҜдәәвҖқ

- зҺҜзҗғж—¶жҠҘ|йӣҶдҪ“дёүзӯүеҠҹпјҒдёӯеӣҪй©»дј‘ж–Ҝж•ҰжҖ»йўҶйҰҶе…Ёе‘ҳеҪ’еӣҪ

- зҺҜзҗғж—¶жҠҘ|жҷ®дә¬еҘіе„ҝжү“дҝ„ж–°еҶ з—…жҜ’з–«иӢ—иҮҙжӯ»пјҹ дҝ„еӘ’иҫҹи°Ј

- зҺҜзҗғж—¶жҠҘ|жҫіи®®е‘ҳиӮҶж„ҸжҠ№й»‘иҰҒжұӮе…ій—ӯдёӯеӣҪдёҖйўҶйҰҶ,жҲ‘йўҶйҰҶ:зӣёеҪ“иҚ’и°¬