人工智能|金耀辉/季卫东:AI数据给人“贴标签”,利还是弊?|148期对话

【导读】如果有人故意攻击算法的漏洞 , 导致算法瘫痪 , 法律应当如何设定规则?AI数据给人“贴标签” , 将是未来法治中存在的最大陷阱?本周三(7月8日)晚 , 在第148期文汇讲堂《AI的权利与义务 , 人类说了算?》上 , 16位现场听众和近300名zoom会议室在线听友聆听了季卫东教授逻辑缜密的演讲 , 及其与金耀辉教授分别站台“人类”与“AI”的激情辩论 。

本场讲座由上海市法学会东方法学讲堂和文汇讲堂共同举办 , 以在线直播和在场互动的新形式呈现 。 此篇分享对话 。

约束操控者行为 , 人工智能立法为技术开发等设立法律底线

金耀辉:首先 , 从机器或人工智能技术工程师的角度来说 , 我绝对不敢挑战人类!但是目前 , 人类对人工智能存在许多误区 。 历史上 , “人工智能”一词首次出现在1956年的达特茅斯会议上 , 九年后 , 获得图灵奖和诺贝尔经济学奖的人工智能先驱 , 同时也是中国科学院的外籍院士Herbert Simon预言 , 20年后人工智能就可以取代人类做任何事 。 可是直到1985年 , 人们还都不了解人工智能 。 并且从技术角度看 , 目前的人工智能其实远未达到科幻电影中描述的“天网”等先进程度 。 那么 , 我们现在为何要未雨绸缪地讨论对人工智能的限制问题呢?约束太多不仅束缚了人工智能的发展 , 也给工程师增加了负担 。

事实上 , 与其说约束机器人 , 不如说约束机器人背后的操作者 。 季老师刚才提到的所有人工智能做的坏事 , 其实不是机器做的 , 而是控制机器的人做的 。 法律赋予人类权力的同时 , 也同样约束人类活动 。 所以 , 对人工智能的立法正是为了约束操控机器人的人 , 为技术开发、数据应用等行为设立法律底线 。

季卫东:金老师提出的两个观点非常重要 。 第一 , 人工智能有其发展过程 。 眼下“人工智能热”是因为机器深度学习、计算机能力大幅提高、量子计算机与电商数据的出现 , 导致人工智能变得越来越现实 。 但人工智能想要取代人类还是很遥远的构想 , 因为在人类看来容易的事 , 人工智能要做却不简单 。 最重要的是 , 人类拥有感情 , 根据直觉判断事物 , 但人工智能将所有东西都变成了计算程序 , 这一过程非常漫长且复杂 。 第二 , 我们应当给人工智能留点发展空间 。 我非常赞同这一看法 , 这就是为何我提出 , 不能只强调硬法之治 , 而应结合软法和硬法 , 为人工智能提供原则性的指引方向 , 但不要过于匆忙地设立具体的法律规则来约束其发展 。 包括金教授提到的数据问题 , 如果过分强调个人信息和隐私保护 , 就会束缚人工智能的发展 。 所以 , 从这两个角度看 , 不能一味强调人工智能的治理 , 要注意技术规格、代码框与法律法规之间的适当平衡 。 否则人工智能就没有发展的余地了 。

金老师还提到机器人的主体资格问题 , 也很重要 。 他说最后决定机器行为的不是人工智能 , 而是设计算法的人 , 因此责任在人不在机 。 这也就涉及到人工智能专家与法律专家的关系了 。 包括如何规范电脑工程师的行为 , 他们对技术问题的理解又是怎么样的 。 此时 , 法学研究者、法律从业者与电脑工程师、人工智能专家之间的对话就显得尤为重要 。

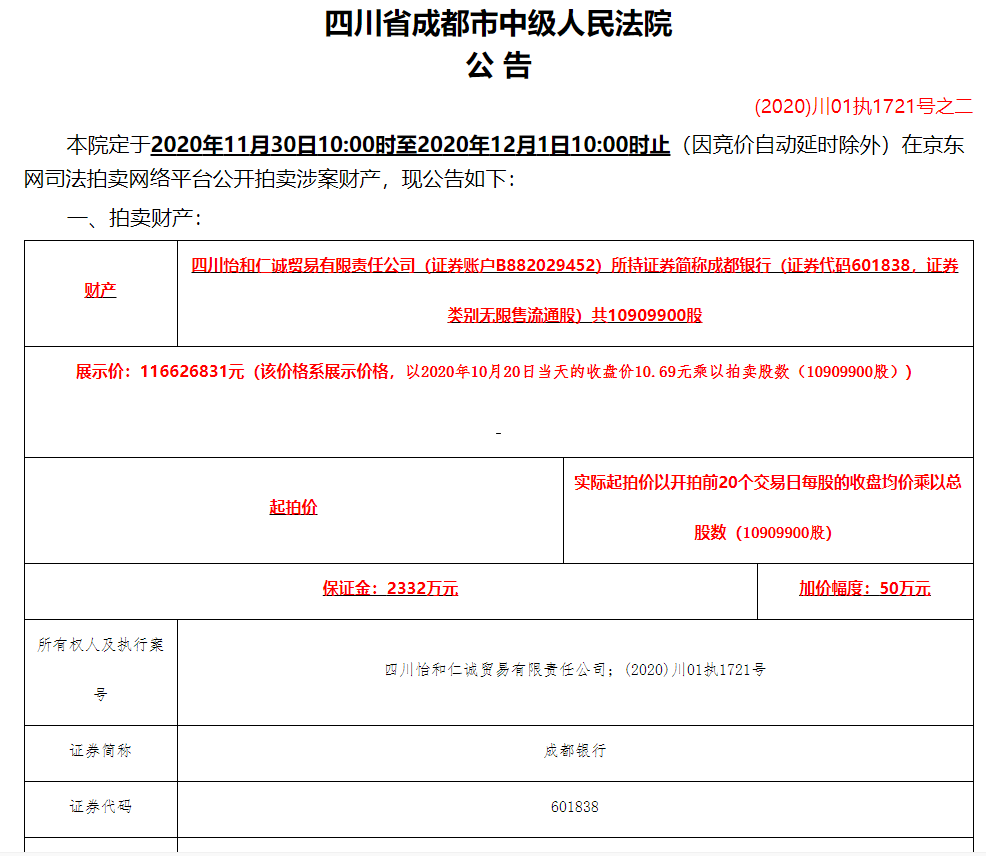

本文插图

上海交大电信学院长聘教授金耀辉(辉)对话上海交大文科资深教授季卫东(左)

自动驾驶事故暴露人工智能三大问题 , 追责成难题

金耀辉:新技术的出现必然会带来挑战 , 汽车刚发明时也面临同样的问题 , 人类拥有许多可以借鉴的经验 。 以自动驾驶技术例 , 自动驾驶通过摄像头来判断交通标识 。 国外曾做过一个有趣的实验 , 在交通信号上稍微增加一些较小的扰动 , 比如噪音的照片 。 人对这些照片不会产生任何误解 , 但人工智能的算法在这方面存在弱点 , 会产生错误判断 。 假设有人故意攻击算法的漏洞 , 导致算法瘫痪 , 这种情况下 , 法律应当如何设定规则?

推荐阅读

- 青年|汕头华侨试验区探索以人工智能、5G赋能产业转型升级

- 行业互联网,AI人工智能|城市教育大脑以“ AI+ 大数据”为核心 , 引领教育变革

- 行业互联网|眼控科技聚焦航空气象报文,人工智能助推编发自动化

- 人工智能|哈工智能布局“AI+ROBOT”生态圈

- 人工智能|马斯克宣布,脑机接口公司将在下月重磅更新,赛博格将成为现实?

- 人工智能|敏捷开发框架的开发运用之智能办公管理系统的开发

- 人工智能|人工智能上车就是聊天唱歌?TA还能给你有温度有情感的陪伴

- 行业互联网,云计算|赛伯乐携手华为(重庆)人工智能创新中心聚焦AI前沿,助力企业数字化转型

- 华为手机,AI人工智能|今天才知道,华为手机右上角还能这样使用,几千块钱果真没白花

- AI人工智能|OpenAI新模型曝光:给它半张图片,能够猜测补全

![[贝鲁特港]“就像世界末日!”贝鲁特港大爆炸前后对比(图)](https://n.sinaimg.cn/sinakd202085s/412/w150h262/20200805/8adf-ixeeisa3068369.gif)