人工智能|金耀辉/季卫东:AI数据给人“贴标签”,利还是弊?|148期对话( 三 )

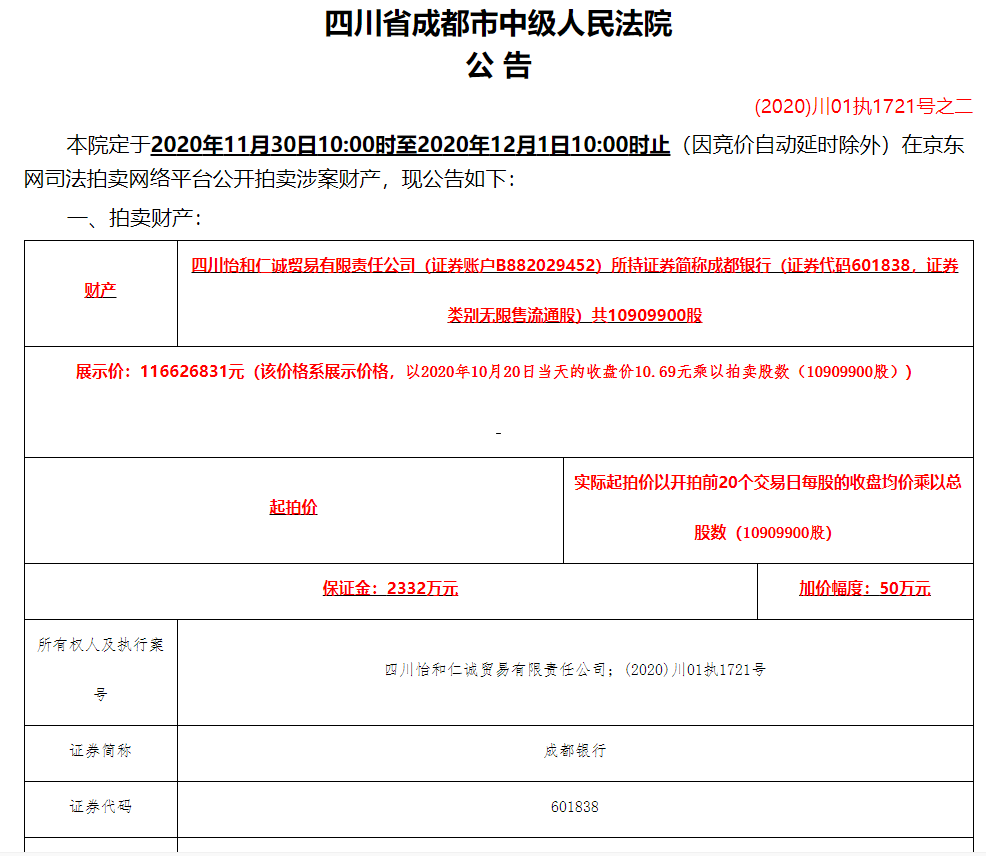

本文插图

人工智能只能翻译 , 但不能理解人类语言背后的含义

季卫东:金老师谈到的两个问题对法律人来说很有意思 , 也很令人费解 。 第一 , 人工智能无法建立一个常识体系 。 那么 , 如何才能让它做出判断呢?首先要确定一定的概率 , 然后进行计算 。 但此时这个数据就会存在问题 。 因为法律适用需要一个确定的、明确的判断 , 不能说正确率有多少 , 但调解一定程度上可以 。 第二 , 从最简单的自动驾驶例子可能更能理解人工智能的特点 。 自动驾驶可以严格按照道路的限速规定自动行驶 。 如果我们运用人工智能进行交通执法 , 似乎也很简单 , 只要输入交通规则就可以了 , 交警也是根据交规判断汽车是否超速 。 然而 , 即便交通规则的适用也具有一定的灵活性 , 需要执法者进行裁量 。 如驾驶速度超出一、两公里 , 或者汽车在绿灯闪烁时加速冲过马路 , 交警并不会做出惩罚 。 这就增加了智能软件设计的复杂程序 。

美国曾做过一项实验 , 将学生分成三组 , 第一组严格按法律规则编程 , 第二组参照法律条文编程序 , 第三组给出关于概率、变动幅度等具体指示进行编程 。 最终 , 第一组的结果非常机械 , 几乎所有人都将面临罚单 。 第二组的结果非常多元 , 而第三组则给出了具体的指示 , 例如超速超过30%就要面临罚单 。 可见 , 若人工智能专家能够给予具体的指示 , 可能会使人工智能软件更加接近人的判断 。

AI数据给人“贴标签” , 或是未来法治中存在的最大陷阱

金耀辉:季老师提到了一个非常好的问题 , 实际上 , 自动驾驶与环境有关 。 我们肯定希望自动驾驶软件能够像人类一样有温度 , 根据外界的环境变化而调整 。 但环境依赖的是数据 , 所以回过头来 , 我们还是要谈谈数据本身的问题 。

人的听觉、嗅觉、直觉等感受能力很强也很多 , 可以通过这些能力做出决策 。 而机器一般根据数据做出判断 。 因此数据很重要 , 并且越多越好 , 但作为人工智能的数据并不可能完整地收集起来 , 所以一定是在非完全的数据输入情况下做出的决策 , 此时就要有一个取舍 。 如果单从算法角度考虑 , 我们需要判断这些数据的关键因素是否缺失 。 例如 , 交通信号灯的重要信息如果缺失 , 那自动驾驶的判断结果必然没用 。 又如判断某人是否怀孕的前提信息要确认这是位女性 。 这些是不能丢失的信息 。

但反过来又要思考 , 这些信息会不会导致隐私的泄露?刚才提到 , 某些视频网站会根据用户的喜好推荐视频 , 这方面涉及的数据共享与保护的问题是目前上海正在研究的 。 政府希望通过数字经济 , 共享数据 , 以刺激更多的中小企业进行创新 。 但这一过程中可能会侵犯用户隐私或商业秘密 。 未来 , 法律界与技术界要共同研究这一问题的解决方案 , 实现数据共享与保护的双重目标 。

另一个问题是 , 网络推荐背后的算法实际上是在给人物打标签 。 例如 , 我订机票时 , 航空公司会推荐比较准时、可以取消的航班 , 因为我身上已有这样的标签 。 贴标签的过程可以部分避免用户的完整数据被交换 , 部分解决了隐私保护问题 。 但是利用其他厂商的生成标签可能会导致推荐算法的不确定性更加无法量化 。 所以学术界也在探索差分隐私或联邦学习的新型算法 。

本文插图

本场讲座以在线直播和在场互动的形式同步呈现

季卫东:金老师关于“贴标签”的说法很精彩 。 刑法学中就有一个标签理论 , 意思是 , 一旦社会给你贴上某个标签 , 旁人就会不断地用这种眼光审视你 。 有点类似中国古代的成语“疑人偷斧” , 导致你处于一个不利的状态 。 反过来 , 若你意识到社会给你贴了这个标签 , 你就会朝着这个方向走 , 最后就真是变成了标签上的一样 , 即预言的自我实现 。

推荐阅读

- 青年|汕头华侨试验区探索以人工智能、5G赋能产业转型升级

- 行业互联网,AI人工智能|城市教育大脑以“ AI+ 大数据”为核心 , 引领教育变革

- 行业互联网|眼控科技聚焦航空气象报文,人工智能助推编发自动化

- 人工智能|哈工智能布局“AI+ROBOT”生态圈

- 人工智能|马斯克宣布,脑机接口公司将在下月重磅更新,赛博格将成为现实?

- 人工智能|敏捷开发框架的开发运用之智能办公管理系统的开发

- 人工智能|人工智能上车就是聊天唱歌?TA还能给你有温度有情感的陪伴

- 行业互联网,云计算|赛伯乐携手华为(重庆)人工智能创新中心聚焦AI前沿,助力企业数字化转型

- 华为手机,AI人工智能|今天才知道,华为手机右上角还能这样使用,几千块钱果真没白花

- AI人工智能|OpenAI新模型曝光:给它半张图片,能够猜测补全

![[贝鲁特港]“就像世界末日!”贝鲁特港大爆炸前后对比(图)](https://n.sinaimg.cn/sinakd202085s/412/w150h262/20200805/8adf-ixeeisa3068369.gif)