「驱动之家」ARM下代处理器架构将支持BFloat16指令集 AI性能暴增数倍

深度学习、AI人工智能等技术正在成为各大处理器的热点 , 虽然目前的主流是通过专用的NPU单元来加速AI指令 , 但在CPU中集成相应的指令集也会带来很大的改变 , Intel在Cascade Lake及10nm Ice Lake处理器中就加入了BFlota16指令集(简称BF16) , AI性能达到了前代的2.5倍以上 。

ARM今天也宣布了类似的动作 , 将在下一版ARMv8架构中加入新的Non及SVE指令 , 以便支持BFloat16运算 。

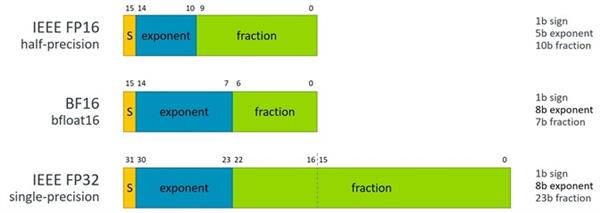

BF16运算还不是IEEE的标准 , 但与标准的FP32浮点、FP16半精度相比 , BF16运算优点多多 , 它可以轻松取代FP32 , 而且还能保持正确的NN神经网络操作 , 这点是FP16做不到的 , 而且它占用的内存及贷款只有FP32一半 , 所以性能更高 , 而且不需要复杂的架构改变 。

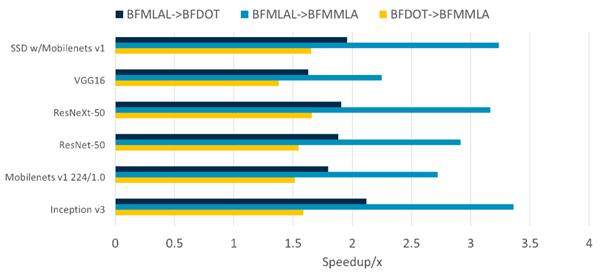

总之 , 支持BF16运算优点多多 , 根据ARM做的模拟 , 不同类型的运算中BF16带来的性能提升不等 , 少的有1.6倍性能 , 多的可达4倍性能 , 所以在AI方面性能变化是非常大的 , 是前代的数倍之多 。

----「驱动之家」ARM下代处理器架构将支持BFloat16指令集 AI性能暴增数倍 //----[ http://www.caoding.cn]

----「驱动之家」ARM下代处理器架构将支持BFloat16指令集 AI性能暴增数倍 //----[ http://www.caoding.cn]

----「驱动之家」ARM下代处理器架构将支持BFloat16指令集 AI性能暴增数倍 //----[ http://www.caoding.cn]

推荐阅读

- 三国杀:卡牌是否应该“界限突破”?且看这版「界闪电」设计如何

- 「周榜」9件最抢手美衣

- 「连麦两会」两位90后村支书隔空分享战“疫”中的乡村管理经验,共谋致富奔小康之路

- 「两会访谈」新冠疫情下的外贸企业突围之路

- 「图解」半导体成当之无愧吸金王,2.8亿资金打板紫光国微

- 「威客电竞CSGO」ESL里约欧洲淘汰赛,Astralis 3比0碾压G2获冠军

- 最强神父!「圣水喷射攻击」净化信徒那颗邪恶的心

- 深夜美食之「红酒焗排骨」,熬最长的夜,吃最香的排骨

- 「战国四公子之」平原君挖的大坑和毛遂自荐

- 「生活」早起做四件事,肝脏健康没毛病