人工智能冒充人刷假新闻、灌水评论怎么办?让人工智能来鉴别

人工智能现在的写作能力虽然还不至于写出世界名著 , 但足以掩藏住机器的痕迹 , 混淆普通人的视线 。 最重要的是 , AI可以批量生产文本 , 炮制假新闻、快速刷评论 。 该如何揪出冒充人类的AI呢?哈佛大学和麻省理工学院- IBM沃森人工智能实验室(MIT-IBM Watson AI Lab)的研究人员想到了用AI识别AI 。

他们开发了一种叫做“巨型语言模型测试器”(GLTR)的新工具 , 用于识别人工智能生成的文本 。 其辨别原理基于:人工智能是利用文本中的统计模式来自动生成文本的 , 而不考虑单词和句子的实际含义 。 也就是说 , 如果一篇文章中的用词都是可预测的 , 该文章就极可能是由人工智能写的 , 而GLTR可以标注出文章用词是否可预测 。

开发最厚的盾 , 就要用最强的矛来测试 。 前一阵子 , 埃隆·马斯克参与创立的AI研究机构OpenAI推出了一种算法 , 可以自动生成真实度极高的段落 。 只要在该算法的“学习模式”中输入海量数据 , 该算法就可以统计词频 , 组合高频词 , 生成新的段落 。 而哈佛大学的团队正是用Open AI公开发布的代码为基础 , 发明了GLTR 。

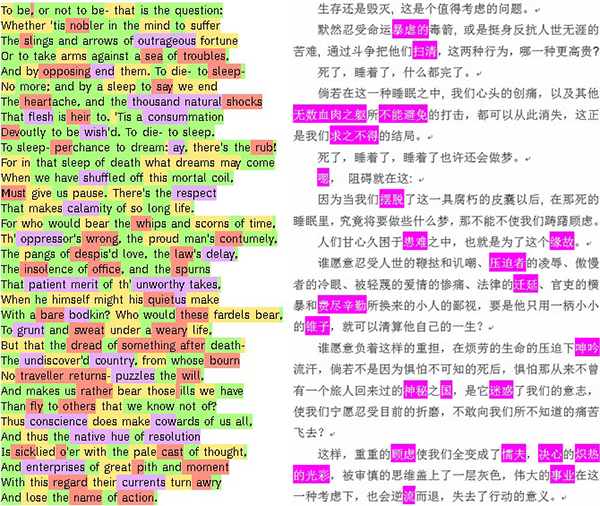

GLTR可以根据词频 , 标明最可能出现的单词搭配 。 最易预测的单词是绿色的 , 较难预测的是黄色和红色的 , 最难预测的是紫色的 。 当对Open AI编写的算法所生成的文字进行测试后 , 发现大部分单词都可预测;而人类写出的新闻和科学摘要文字搭配更多样 。

那么 , 什么样的用词才是AI无法模仿的“人来之笔”呢?澎湃新闻采访人员将《哈姆雷特》中脍炙人口的段落放进该工具中检索 。

----人工智能冒充人刷假新闻、灌水评论怎么办?让人工智能来鉴别//----[ http://www.caoding.cn]

《哈姆雷特》选段 , 右为中文译文

可以看到 , 莎翁的手笔确实不是AI能轻易揣摩的 , 短短的片段中就出现了20多处标紫 。 第一处标紫的“暴虐”虽非多么生僻的词汇 , 但用来修饰“命运”却并不常见 。 在AI眼中 , 这种搭配犹能体现出“人性之光” 。

GLTR的研究人员让哈佛的学生分别在不使用GLTR、和使用GLTR的时候 , 判断文本是否是人工智能生成的 。 实验结果表明 , 在不使用GLTR时 , 学生们只能识别出一半的虚假文本;而看到GLTR所做的标注后 , 他们可以识别出72%的虚假文本 。 Sebastian Gehrmanns是一位参与GLTR发明的博士生 , 他表明:“我们的目标是建立一个人类和人工智能协作的体系 。 ”

《麻省理工科技评论》对此评价道 , 现在自动生成的假消息越来越多 , 这种AI工具或许能有效打击机器制造的假新闻、假视频和灌水评论 。

推荐阅读

- 小米高管质疑电视拆机,喊话荣耀赵明:怀疑有人冒充贵品牌抹黑小米

- 人工智能修复 100 年前北京影像,有哪些意义和可以应用的方向?

- 掌尚策资本进入人工智能领域吸引高端人才加入

- 已婚男冒充警察骗女生20万,被抓大吼:我是警察

- 刘庆锋建议:利用人工智能提升基层诊疗能力、强化公共卫生服务

- 人工智能将“吞噬”数据

- 量子计算将进入新时代,为人工智能和物联网发展提速

- 上海马桥举行人工智能招商会,居然从4000年前说起……

- 消毒、送餐……“火神山”同款人工智能机器人亮相银川

- “永生人”已经实现了?科学家新思路,或能通过人工智能实现!