еӨ§иҮҙжӯҘйӘӨдёәдёӨжӯҘпјҡ

- жң¬ең°жүҫеҮә Top K зү№еҫҒпјҢ并еҹәдәҺжҠ•зҘЁзӯӣйҖүеҮәеҸҜиғҪжҳҜжңҖдјҳеҲҶеүІзӮ№зҡ„зү№еҫҒпјӣ

- еҗҲ并时еҸӘеҗҲ并жҜҸдёӘжңәеҷЁйҖүеҮәжқҘзҡ„зү№еҫҒ гҖӮ

ж–Үз« жҸ’еӣҫ

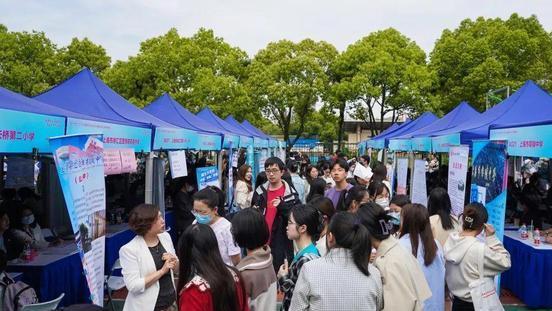

еӣҫпјҡжҠ•зҘЁе№¶иЎҢ

3.3 Cacheе‘ҪдёӯзҺҮдјҳеҢ–

XGBoostеҜ№cacheдјҳеҢ–дёҚеҸӢеҘҪпјҢеҰӮдёӢеӣҫжүҖзӨә гҖӮеңЁйў„жҺ’еәҸеҗҺпјҢзү№еҫҒеҜ№жўҜеәҰзҡ„и®ҝй—®жҳҜдёҖз§ҚйҡҸжңәи®ҝй—®пјҢ并且дёҚеҗҢзҡ„зү№еҫҒи®ҝй—®зҡ„йЎәеәҸдёҚдёҖж ·пјҢж— жі•еҜ№cacheиҝӣиЎҢдјҳеҢ– гҖӮеҗҢж—¶пјҢеңЁжҜҸдёҖеұӮй•ҝж ‘зҡ„ж—¶еҖҷпјҢйңҖиҰҒйҡҸжңәи®ҝй—®дёҖдёӘиЎҢзҙўеј•еҲ°еҸ¶еӯҗзҙўеј•зҡ„ж•°з»„пјҢ并且дёҚеҗҢзү№еҫҒи®ҝй—®зҡ„йЎәеәҸд№ҹдёҚдёҖж ·пјҢд№ҹдјҡйҖ жҲҗиҫғеӨ§зҡ„cache miss гҖӮдёәдәҶи§ЈеҶізј“еӯҳе‘ҪдёӯзҺҮдҪҺзҡ„й—®йўҳпјҢXGBoost жҸҗеҮәдәҶзј“еӯҳи®ҝй—®з®—жі•иҝӣиЎҢж”№иҝӣ гҖӮ

ж–Үз« жҸ’еӣҫ

еӣҫпјҡйҡҸжңәи®ҝй—®дјҡйҖ жҲҗcache miss

иҖҢ LightGBM жүҖдҪҝз”Ёзӣҙж–№еӣҫз®—жі•еҜ№ Cache еӨ©з”ҹеҸӢеҘҪпјҡ

- йҰ–е…ҲпјҢжүҖжңүзҡ„зү№еҫҒйғҪйҮҮз”ЁзӣёеҗҢзҡ„ж–№ејҸиҺ·еҫ—жўҜеәҰпјҲеҢәеҲ«дәҺXGBoostзҡ„дёҚеҗҢзү№еҫҒйҖҡиҝҮдёҚеҗҢзҡ„зҙўеј•иҺ·еҫ—жўҜеәҰпјүпјҢеҸӘйңҖиҰҒеҜ№жўҜеәҰиҝӣиЎҢжҺ’еәҸ并еҸҜе®һзҺ°иҝһз»ӯи®ҝй—®пјҢеӨ§еӨ§жҸҗй«ҳдәҶзј“еӯҳе‘ҪдёӯзҺҮпјӣ

- е…¶ж¬ЎпјҢеӣ дёәдёҚйңҖиҰҒеӯҳеӮЁиЎҢзҙўеј•еҲ°еҸ¶еӯҗзҙўеј•зҡ„ж•°з»„пјҢйҷҚдҪҺдәҶеӯҳеӮЁж¶ҲиҖ—пјҢиҖҢдё”д№ҹдёҚеӯҳеңЁ Cache Missзҡ„й—®йўҳ гҖӮ

ж–Үз« жҸ’еӣҫ

еӣҫпјҡLightGBMеўһеҠ зј“еӯҳе‘ҪдёӯзҺҮ

4. LightGBMзҡ„дјҳзјәзӮ№

4.1 дјҳзӮ№

иҝҷйғЁеҲҶдё»иҰҒжҖ»з»“дёӢ LightGBM зӣёеҜ№дәҺ XGBoost зҡ„дјҳзӮ№пјҢд»ҺеҶ…еӯҳе’ҢйҖҹеәҰдёӨж–№йқўиҝӣиЎҢд»Ӣз»Қ гҖӮ

пјҲ1пјүйҖҹеәҰжӣҙеҝ«

- LightGBM йҮҮз”ЁдәҶзӣҙж–№еӣҫз®—жі•е°ҶйҒҚеҺҶж ·жң¬иҪ¬еҸҳдёәйҒҚеҺҶзӣҙж–№еӣҫпјҢжһҒеӨ§зҡ„йҷҚдҪҺдәҶж—¶й—ҙеӨҚжқӮеәҰпјӣ

- LightGBM еңЁи®ӯз»ғиҝҮзЁӢдёӯйҮҮз”ЁеҚ•иҫ№жўҜеәҰз®—жі•иҝҮж»ӨжҺүжўҜеәҰе°Ҹзҡ„ж ·жң¬пјҢеҮҸе°‘дәҶеӨ§йҮҸзҡ„и®Ўз®—пјӣ

- LightGBM йҮҮз”ЁдәҶеҹәдәҺ Leaf-wise з®—жі•зҡ„еўһй•ҝзӯ–з•Ҙжһ„е»әж ‘пјҢеҮҸе°‘дәҶеҫҲеӨҡдёҚеҝ…иҰҒзҡ„и®Ўз®—йҮҸпјӣ

- LightGBM йҮҮз”ЁдјҳеҢ–еҗҺзҡ„зү№еҫҒ并иЎҢгҖҒж•°жҚ®е№¶иЎҢж–№жі•еҠ йҖҹи®Ўз®—пјҢеҪ“ж•°жҚ®йҮҸйқһеёёеӨ§зҡ„ж—¶еҖҷиҝҳеҸҜд»ҘйҮҮз”ЁжҠ•зҘЁе№¶иЎҢзҡ„зӯ–з•Ҙпјӣ

- LightGBM еҜ№зј“еӯҳд№ҹиҝӣиЎҢдәҶдјҳеҢ–пјҢеўһеҠ дәҶзј“еӯҳе‘ҪдёӯзҺҮпјӣ

пјҲ2пјүеҶ…еӯҳжӣҙе°Ҹ

- XGBoostдҪҝз”Ёйў„жҺ’еәҸеҗҺйңҖиҰҒи®°еҪ•зү№еҫҒеҖјеҸҠе…¶еҜ№еә”ж ·жң¬зҡ„з»ҹи®ЎеҖјзҡ„зҙўеј•пјҢиҖҢ LightGBM дҪҝз”ЁдәҶзӣҙж–№еӣҫз®—жі•е°Ҷзү№еҫҒеҖјиҪ¬еҸҳдёә bin еҖјпјҢдё”дёҚйңҖиҰҒи®°еҪ•зү№еҫҒеҲ°ж ·жң¬зҡ„зҙўеј•пјҢе°Ҷз©әй—ҙеӨҚжқӮеәҰд»Һ йҷҚдҪҺдёә пјҢжһҒеӨ§зҡ„еҮҸе°‘дәҶеҶ…еӯҳж¶ҲиҖ—пјӣ

- LightGBM йҮҮз”ЁдәҶзӣҙж–№еӣҫз®—жі•е°ҶеӯҳеӮЁзү№еҫҒеҖјиҪ¬еҸҳдёәеӯҳеӮЁ bin еҖјпјҢйҷҚдҪҺдәҶеҶ…еӯҳж¶ҲиҖ—пјӣ

- LightGBM еңЁи®ӯз»ғиҝҮзЁӢдёӯйҮҮз”Ёдә’ж–Ҙзү№еҫҒжҚҶз»‘з®—жі•еҮҸе°‘дәҶзү№еҫҒж•°йҮҸпјҢйҷҚдҪҺдәҶеҶ…еӯҳж¶ҲиҖ— гҖӮ

- еҸҜиғҪдјҡй•ҝеҮәжҜ”иҫғж·ұзҡ„еҶізӯ–ж ‘пјҢдә§з”ҹиҝҮжӢҹеҗҲ гҖӮеӣ жӯӨLightGBMеңЁLeaf-wiseд№ӢдёҠеўһеҠ дәҶдёҖдёӘжңҖеӨ§ж·ұеәҰйҷҗеҲ¶пјҢеңЁдҝқиҜҒй«ҳж•ҲзҺҮзҡ„еҗҢж—¶йҳІжӯўиҝҮжӢҹеҗҲпјӣ

- Boostingж—ҸжҳҜиҝӯд»Јз®—жі•пјҢжҜҸдёҖж¬Ўиҝӯд»ЈйғҪж №жҚ®дёҠдёҖж¬Ўиҝӯд»Јзҡ„йў„жөӢз»“жһңеҜ№ж ·жң¬иҝӣиЎҢжқғйҮҚи°ғж•ҙпјҢжүҖд»ҘйҡҸзқҖиҝӯд»ЈдёҚж–ӯиҝӣиЎҢпјҢиҜҜе·®дјҡи¶ҠжқҘи¶Ҡе°ҸпјҢжЁЎеһӢзҡ„еҒҸе·®пјҲbiasпјүдјҡдёҚж–ӯйҷҚдҪҺ гҖӮз”ұдәҺLightGBMжҳҜеҹәдәҺеҒҸе·®зҡ„з®—жі•пјҢжүҖд»ҘдјҡеҜ№еҷӘзӮ№иҫғдёәж•Ҹж„ҹпјӣ

- еңЁеҜ»жүҫжңҖдјҳи§Јж—¶пјҢдҫқжҚ®зҡ„жҳҜжңҖдјҳеҲҮеҲҶеҸҳйҮҸпјҢжІЎжңүе°ҶжңҖдјҳи§ЈжҳҜе…ЁйғЁзү№еҫҒзҡ„з»јеҗҲиҝҷдёҖзҗҶеҝөиҖғиҷ‘иҝӣеҺ»пјӣ

жң¬зҜҮж–Үз« жүҖжңүж•°жҚ®йӣҶе’Ңд»Јз ҒеқҮеңЁжҲ‘зҡ„GitHubдёӯпјҢең°еқҖпјҡ

https://github.com/Microstrong0305/WeChat-zhihu-csdnblog-code/tree/master/Ensemble%20Learning/LightGBM

5.1 е®үиЈ…LightGBMдҫқиө–еҢ…

pip install lightgbm5.2 LightGBMеҲҶзұ»е’ҢеӣһеҪ’LightGBMжңүдёӨеӨ§зұ»жҺҘеҸЈпјҡLightGBMеҺҹз”ҹжҺҘеҸЈ е’Ң scikit-learnжҺҘеҸЈ пјҢ并且LightGBMиғҪеӨҹе®һзҺ°еҲҶзұ»е’ҢеӣһеҪ’дёӨз§Қд»»еҠЎ гҖӮ

пјҲ1пјүеҹәдәҺLightGBMеҺҹз”ҹжҺҘеҸЈзҡ„еҲҶзұ»

import lightgbm as lgbfrom sklearn import datasetsfrom sklearn.model_selection import train_test_splitimport numpy as npfrom sklearn.metrics import roc_auc_score, accuracy_score# еҠ иҪҪж•°жҚ®iris = datasets.load_iris# еҲ’еҲҶи®ӯз»ғйӣҶе’ҢжөӢиҜ•йӣҶX_train, X_test, y_train, y_test = train_test_split(iris.data, iris.target, test_size=0.3)# иҪ¬жҚўдёәDatasetж•°жҚ®ж јејҸtrain_data = https://www.isolves.com/it/ai/2022-03-04/lgb.Dataset(X_train, label=y_train)validation_data = lgb.Dataset(X_test, label=y_test)# еҸӮж•°params = {'learning_rate': 0.1,'lambda_l1': 0.1,'lambda_l2': 0.2,'max_depth': 4,'objective': 'multiclass', # зӣ®ж ҮеҮҪж•°'num_class': 3,}# жЁЎеһӢи®ӯз»ғgbm = lgb.train(params, train_data, valid_sets=[validation_data])# жЁЎеһӢйў„жөӢy_pred = gbm.predict(X_test)y_pred = [list(x).index(max(x)) for x in y_pred]print(y_pred)# жЁЎеһӢиҜ„дј°print(accuracy_score(y_test, y_pred))

жҺЁиҚҗйҳ…иҜ»

- AMD|AMD Zen4й”җйҫҷвҖңйҫҷеҮӨиғҺвҖқжқҘдәҶпјҡ55WеҠҹиҖ—гҖҒжёёжҲҸжң¬з»ҲдәҺж»ЎиЎҖ

- 家й•ҝзҡ„йј“еҠұе’ҢеёҢжңӣеҜ„иҜӯжңүе“Әдәӣпјҹ

- еҰӮдҪ•еҪ»еә•зҰҒз”ЁжүӢжңәеҶ…зҪ®жөҸи§ҲеҷЁпјҹ

- дәҡ马йҖҠ|еҸ‘еёғ15е№ҙеҗҺ дәҡ马йҖҠKindleз»ҲдәҺж”ҜжҢҒePubз”өеӯҗд№Ұж јејҸдәҶ

- дёҖж–Үи®©дҪ еҪ»еә•жҗһжё…жҘҡпјҢLinuxйӣ¶жӢ·иҙқжҠҖжңҜзҡ„йӮЈдәӣдәӢе„ҝ

- дёӘдәәзҪ‘з«ҷз«ҷй•ҝзҡ„ж—¶д»ЈиҰҒеҪ»еә•иҗҪ幕дәҶпјҢжҢҘжүӢдёҚеёҰдә‘еҪ©

- иҙўжҠҘ|з»“жқҹдёүе№ҙиҝһдәҸ й•ҝе®үжұҪиҪҰз»ҲдәҺйқ еҚ–иҪҰиөҡй’ұдәҶ

- Win11еҪ»еә•и§ЈеҶізі»з»ҹи“қеұҸй—®йўҳз®ҖеҚ•зІ—жҡҙпјҒеҸӘжҳҜиғҢжҷҜжҚўжҲҗдәҶй»‘еұҸ

- еқҡжҢҒиӢҰеӯҰ TCPпјҢз»ҲдәҺжҠҠ TCP еҚҸи®®з»ҷеӯҰжҳҺзҷҪдәҶпјҢеқҡжҢҒзңӢе®ҢдҪ дјҡ收иҺ·еҫҲеӨ§

- дҫҝз§ҳжҖҺд№Ҳи°ғзҗҶ 12йЈҹз–—ж–№её®дҪ еҪ»еә•иҝңзҰ»дҫҝз§ҳ