十折交叉验证用来测试算法准确性 。将数据集分成十份,轮流将其中九份作为训练数据,一份作为测试数据,进行试验 。每次试验都会得出相应的正确率(或差错率) 。十次的结果的正确率(或差错率)的平均值作为对算法精度的估计,一般还需要进行多次十折交叉验证(例如十次十折交叉验证),再求其均值,作为对算法准确性的估计 。

下面假设构建了十折交叉验证,训练得到十个CNN模型 。

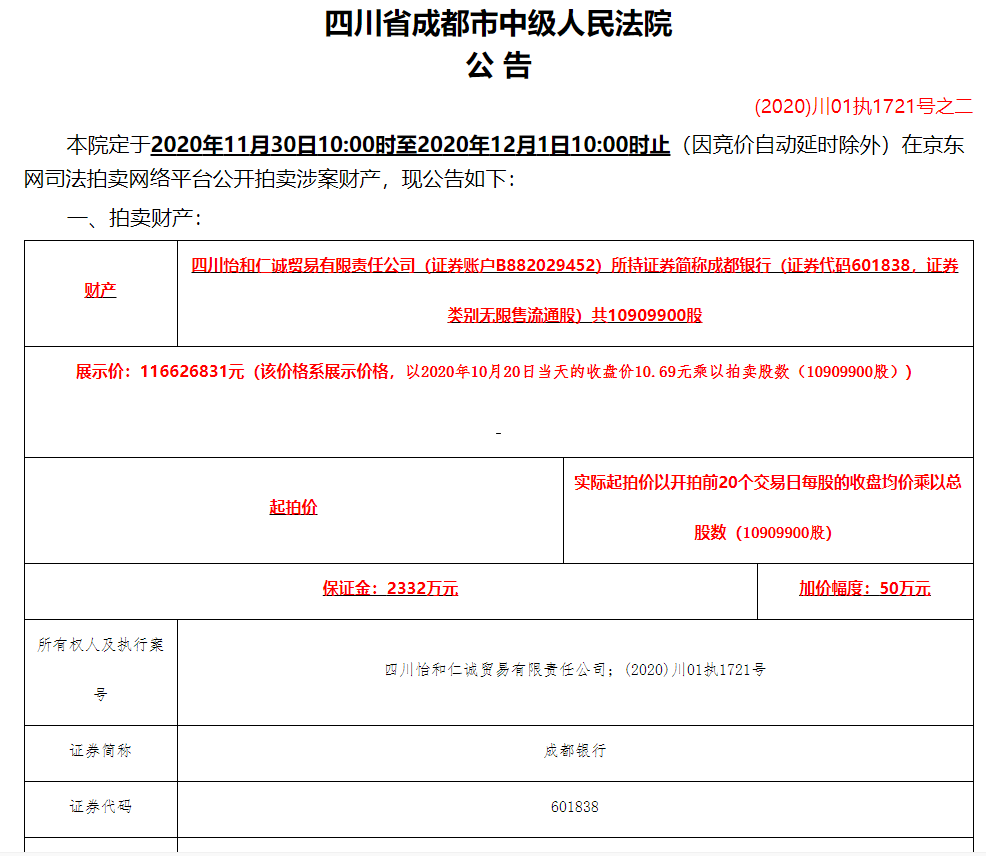

文章插图

那么在十个CNN模型可以使用如下方式进行集成:

- 对预测的结果的概率值进行平均,然后解码为具体字符;

- 对预测的字符进行投票,得到最终字符 。

- 丢弃法Dropout

- 测试集数据扩增TTA

- Snapshot

Dropout可以作为训练深度神经网络的一种技巧 。在每个训练批次中,通过随机让一部分的节点停止工作 。同时在预测的过程中让所有的节点都起作用 。

文章插图

Dropout经常出现在在先有的CNN网络中,可以有效的缓解模型过拟合的情况,也可以在预测时增加模型的精度 。加入Dropout后的网络结构如下:

# 定义模型class SVHN_Model1(nn.Module):def __init__(self):super(SVHN_Model1, self).__init__()# CNN提取特征模块self.cnn = nn.Sequential(nn.Conv2d(3, 16, kernel_size=(3, 3), stride=(2, 2)),nn.ReLU(),nn.Dropout(0.25),nn.MaxPool2d(2),nn.Conv2d(16, 32, kernel_size=(3, 3), stride=(2, 2)),nn.ReLU(),nn.Dropout(0.25),nn.MaxPool2d(2),)#self.fc1 = nn.Linear(32*3*7, 11)self.fc2 = nn.Linear(32*3*7, 11)self.fc3 = nn.Linear(32*3*7, 11)self.fc4 = nn.Linear(32*3*7, 11)self.fc5 = nn.Linear(32*3*7, 11)self.fc6 = nn.Linear(32*3*7, 11)def forward(self, img):feat = self.cnn(img)feat = feat.view(feat.shape[0], -1)c1 = self.fc1(feat)c2 = self.fc2(feat)c3 = self.fc3(feat)c4 = self.fc4(feat)c5 = self.fc5(feat)c6 = self.fc6(feat)return c1, c2, c3, c4, c5, c62. 测试集数据扩增TTA测试集数据扩增(Test Time Augmentation,简称TTA)也是常用的集成学习技巧,数据扩增不仅可以在训练时候用,而且可以同样在预测时候进行数据扩增,对同一个样本预测三次,然后对三次结果进行平均 。

文章插图

def predict(test_loader, model, tta=10):model.eval()test_pred_tta = None# TTA 次数for _ in range(tta):test_pred = []with torch.no_grad():for i, (input, target) in enumerate(test_loader):c0, c1, c2, c3, c4, c5 = model(data[0])output = np.concatenate([c0.data.numpy(), c1.data.numpy(),c2.data.numpy(), c3.data.numpy(),c4.data.numpy(), c5.data.numpy()], axis=1)test_pred.Append(output)test_pred = np.vstack(test_pred)if test_pred_tta is None:test_pred_tta = test_predelse:test_pred_tta += test_predreturn test_pred_ttaSnapshot本章的开头已经提到,假设我们训练了10个CNN则可以将多个模型的预测结果进行平均 。但是加入只训练了一个CNN模型,如何做模型集成呢?

在论文Snapshot Ensembles中,作者提出使用cyclical learning rate进行训练模型,并保存精度比较好的一些checkopint,最后将多个checkpoint进行模型集成 。

文章插图

由于在cyclical learning rate中学习率的变化有周期性变大和减少的行为,因此CNN模型很有可能在跳出局部最优进入另一个局部最优 。在Snapshot论文中作者通过使用表明,此种方法可以在一定程度上提高模型精度,但需要更长的训练时间 。

文章插图

写到最后在不同的任务中可能会有不同的解决方案,不同思路的模型不仅可以互相借鉴,同时也可以修正最终的预测结果 。

在本次赛题中,可以从以下几个思路对预测结果进行后处理:

- 统计图片中每个位置字符出现的频率,使用规则修正结果;

- 单独训练一个字符长度预测模型,用来预测图片中字符个数,并修正结果 。

- 书籍:《深度实践OCR:基于深度学习的文字识别》

- 作者:刘树春 阿里巴巴本地生活研究院算法专家,前复旦七牛云联合实验室OCR算法负责人

校对:林亦霖

—完—

【基础通俗讲解集成学习算法】

推荐阅读

- 把计算机“防火墙”说的通俗易懂,这篇文章做到了

- 淘宝如何做到月销几千 淘宝新店怎么做基础销量

- 太厉害了!总算有人把“串行通信”的基础知识讲的明明白白了

- 超全的Python图像处理讲解,小白也能懂

- 混淆矩阵-不再那么令人混淆了

- 做淘宝店铺最基础的运营技巧 淘宝运营注意事项

- 新手淘宝开店入门基础 新手开淘宝店怎么操作

- 自己在家不知道练什么?推荐8个可以每天练习的瑜伽基础动作

- 初学瑜伽基础知识有哪些需要注意的?

- 淘宝基础优化怎么做 淘宝基础优化指的是哪些方面

![[贝鲁特港]“就像世界末日!”贝鲁特港大爆炸前后对比(图)](https://n.sinaimg.cn/sinakd202085s/412/w150h262/20200805/8adf-ixeeisa3068369.gif)