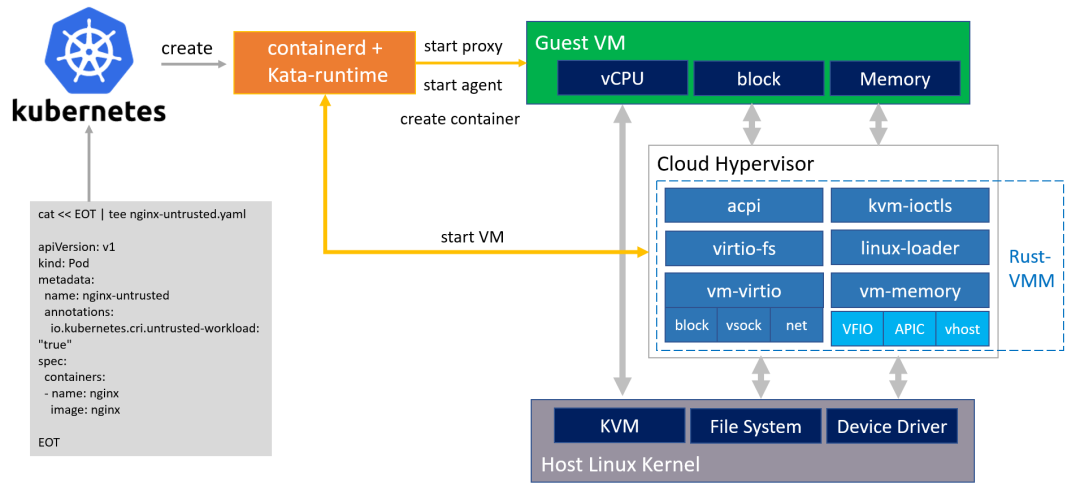

kubernetes|еҹәдәҺRust-vmmе®һзҺ°KubernetesиҝҗиЎҢж—¶

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

йҡҸзқҖе®№еҷЁеҸҠKubernetesзҡ„е№ҝжіӣдҪҝз”Ё пјҢ и¶ҠжқҘи¶ҠеӨҡзҡ„е®№еҷЁе®үе…ЁдёҺйҡ”зҰ»й—®йўҳиў«жҡҙйңІеҮәжқҘ пјҢ еҰӮпјҡе®№еҷЁйҖғйҖёгҖҒж°ҙе№іж”»еҮ»гҖҒDDosж”»еҮ»зӯүдёҘйҮҚеЁҒиғҒдәҶеҠһе…¬е’Ңз”ҹдә§зҺҜеўғзҡ„е®үе…ЁдёҺзЁіе®ҡ пјҢ еҪұе“ҚдәҶдёҡеҠЎзҡ„жӯЈеёёиҝҗиЎҢ гҖӮ е®үе…Ёе®№еҷЁжҠҖжңҜеӯ•иӮІиҖҢз”ҹ пјҢ дә§з”ҹдәҶKataгҖҒgVisorгҖҒunikernelзӯүеӨҡз§Қе®үе…Ёе®№еҷЁж–№жЎҲ гҖӮ жң¬ж–Үж—ЁеңЁд»Ӣз»Қеҗ„з§Қе®үе…Ёе®№еҷЁж–№жЎҲ пјҢ еҲҶжһҗеҗ„ж–№жЎҲзү№зӮ№ пјҢ з»“еҗҲи…ҫи®ҜеңЁе®№еҷЁе®үе…ЁйўҶеҹҹзҡ„е®һи·ө пјҢ её®еҠ©иҜ»иҖ…йҖүжӢ©йҖӮеҗҲиҮӘиә«зү№жҖ§зҡ„е®№еҷЁиҝҗиЎҢж—¶ гҖӮ еҗҢж—¶еј•е…ҘRust-VMMйЎ№зӣ® пјҢ д»Ӣз»Қ Rust-VMM жҠҖжңҜе’Ңз”ҹжҖҒ пјҢ жј”зӨәеҰӮдҪ•дҪҝз”ЁKubernetesи°ғеәҰе’ҢеҗҜз”ЁRust-VMMе®үе…Ёе®№еҷЁиҝҗиЎҢж—¶ пјҢ еұ•жңӣд»ҘRustиҜӯиЁҖе®һзҺ°зҡ„е®№еҷЁиҝҗиЎҢж—¶зҡ„е№ҝйҳ”еүҚжҷҜ гҖӮ

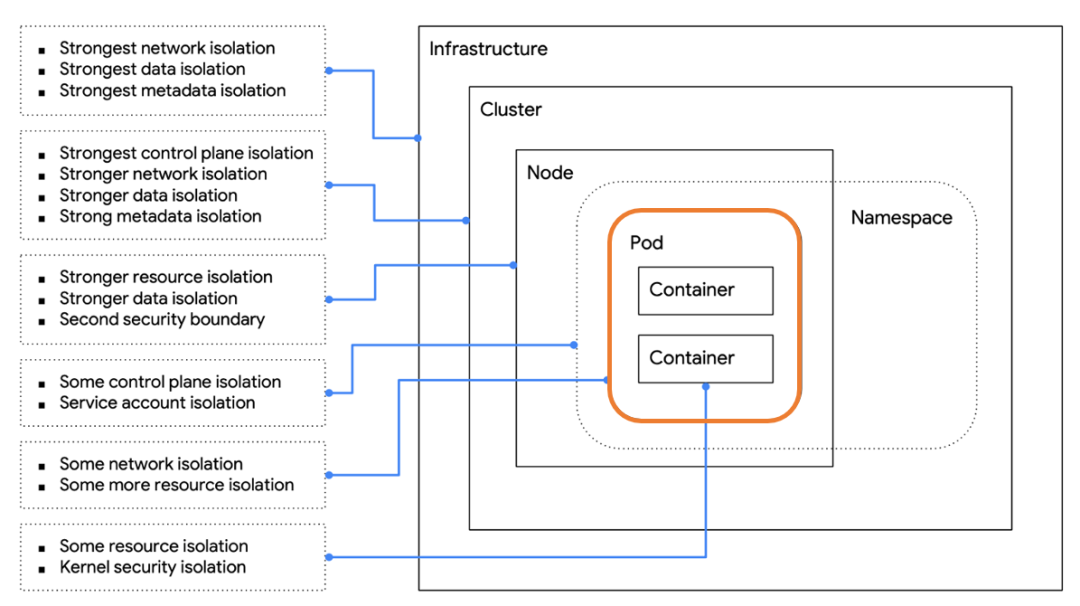

е®№еҷЁе®үе…ЁдёҺйҡ”зҰ»дёҖдёӘеҹәдәҺKubernetesйӣҶзҫӨжһ„е»әзҡ„еҹәзЎҖи®ҫж–Ҫдёӯ пјҢ еҶ…йғЁеӯҳеңЁдёҚеҗҢеұӮж¬Ўзҡ„йҡ”зҰ» пјҢ д»Һе®№еҷЁеҲ°PodеҶҚеҲ°иҠӮзӮ№жңҖеҗҺеҲ°cluster пјҢ жҜҸдёҖеұӮйҡ”зҰ»йғҪжңүе®ғзҡ„зү№зӮ№е’Ңзү№жҖ§ пјҢ жҲ‘们е°Өе…¶е…іжіЁPodзә§еҲ«зҡ„йҡ”зҰ»зү№жҖ§ гҖӮ

зӣёжҜ”е…¶д»–еұӮж¬Ўзҡ„е®үе…Ёйҡ”зҰ» пјҢ PodеҸҠе®№еҷЁзә§еҲ«зҡ„йҡ”зҰ»еҜ№жҲ‘们зҡ„жҢ‘жҲҳйқһеёёеӨ§ гҖӮ е®№еҷЁеңЁиҝҗиЎҢж—¶дҪҝз”ЁrootиҝҗиЎҢиҝӣзЁӢ пјҢ е°Ҫз®ЎдҪҝз”ЁnamespaceжҠҖжңҜдёәе®№еҷЁз©әй—ҙеҶ…зҡ„pidгҖҒutsгҖҒfibзӯүиҝӣиЎҢдәҶйҡ”зҰ» пјҢ дҪҶз”ұдәҺеҗ„дёӘе®№еҷЁе…ұдә«зі»з»ҹеҶ…ж ё пјҢ е®№еҷЁдёҺеҶ…ж ёй—ҙзјәд№Ҹйҡ”зҰ»дҝқжҠӨ пјҢ е®№жҳ“еј•еҸ‘е®№еҷЁйҖғйҖёзӯүе®үе…Ёй—®йўҳ пјҢ е…ёеһӢе®№еҷЁйҖғйҖёж”»еҮ»еҰӮпјҡCVE-2018-14634гҖҒCVE-2016-5195гҖҒCVE-2019-5736 еҸҠ CVE-2019-14271зӯү гҖӮ

docker.vh.neargle.com:8888/?command_exec=python3 -c \"import docker;client = docker.DockerClient(base_url='unix:///var/run/docker.sock');data = client.containers.run('alpine:latest' r'''sh -c \\\"echo 'ssh-rsa xxxxx root@620e839e9b02' >> /tmp/root/root/.ssh/authorized_keys\\\" ''' remove=True volumes={'/': {'bind': '/tmp/root' 'mode': 'rw')\"

дёҠиҝ°и„ҡжң¬жҳҜдёҖдёӘз®ҖеҚ•зҡ„дҫӢеӯҗ пјҢ иҝҷж®өд»Јз Ғдјҡеҗ‘docker.sockзҡ„з«ҜеҸЈеҸ‘иө·иҜ·жұӮ пјҢ жӢүиө·дёҖдёӘalpineзҡ„е®№еҷЁ пјҢ е®№еҷЁеҶ…иҝӣзЁӢдјҡеҗ‘жүҖеңЁдё»жңәжіЁе…ҘдёҖж®өSSHзҡ„е…¬й’Ҙ гҖӮ еңЁе®№еҷЁйҮҢзҡ„жҒ¶ж„Ҹз”ЁжҲ·жҲ–иҖ…ж”»еҮ»иҖ… пјҢ е°ұеҸҜд»ҘиҺ·иҪ»жқҫеҫ—иҝҷдёӘе®№еҷЁжүҖеңЁhostдё»жңәзҡ„SSHзҡ„зҷ»еҪ•жқғйҷҗ пјҢ д»ҺиҖҢиғҪеӨҹйқһжі•жҹҘзңӢеҗҢдё»жңәе…¶д»–е®№еҷЁз©әй—ҙзҡ„дҝЎжҒҜ пјҢ зҜЎж”№е…ій”®ж–Ү件жҲ–и®°еҪ• пјҢ з”ҡиҮід»Ҙдё»жңәдёәи·іжқҝж”»еҮ»ж•ҙдёӘйӣҶзҫӨ гҖӮ

иҝҳжңүдёҖдёӘе°ұжҳҜNoisy Neighbor пјҢ е°ұжҳҜеҗөй—№йӮ»еұ…й—®йўҳ гҖӮ е…ідәҺNoisy Neighbor пјҢ е®№еҷЁж–№йқўе·Із»ҸжңүдәҶеҫҲеӨҡиҝӣеұ• пјҢ жҜ”еҰӮеҜ№дәҺCPUгҖҒmemoryгҖҒbandwidthз”ҡиҮіжҳҜbuffer IO пјҢ еҹәдәҺCgroupеҜ№иҝҷдәӣиө„жәҗе·Із»ҸжңүдәҶдёҖдәӣйҡ”зҰ»е’ҢйҷҗеҲ¶ пјҢ дҪҶжҳҜиҝҷдәӣйҷҗеҲ¶е№¶дёҚиғҪе®Ңе…Ёи§ЈеҶіNoisy Neighborзҡ„й—®йўҳ пјҢ иҝҳжҳҜжңүдёҖдәӣеҗөй—№зҡ„иҝӣзЁӢдјҡеҪұе“ҚеҲ°жӯЈеёёзҡ„дёҡеҠЎиҝӣзЁӢзҡ„иҝҗиЎҢ гҖӮ

# kubectl run --rm -it bb --image=busybox sh

/ # f(){ f|f& ;f # WARNING: Don't try this!

дёҠйқўжҳҜдёҖдёӘз®ҖеҚ•зҡ„дҫӢеӯҗ пјҢ еҗҜеҠЁдёҖдёӘbusyboxзҡ„е®№еҷЁ пјҢ еңЁйҮҢйқўжү§иЎҢдёҖдёӘеөҢеҘ—еҫӘзҺҜзҡ„жҢҮд»Ө пјҢ дјҡжҠҠиҝҷеҸ°дё»жңәдёҠжүҖжңүзҡ„file descriptorе…ЁйғЁиҖ—е°Ҫ пјҢ йҖ жҲҗиҝҷеҸ°дё»жңәдёҠжӯЈеёёиҝҗиЎҢзҡ„дёҡеҠЎиҝӣзЁӢе·ҘдҪңдёҚжӯЈеёё пјҢ иҝҷдёӘжҳҜNoisy Neighborзҡ„йЈҺйҷ©е’Ңй—®йўҳ гҖӮ

еҜ№дәҺдёҠиҝ°й—®йўҳ пјҢ е»әи®®з”ЁжҲ·е…іжіЁе®ҳж–№зҡ„жјҸжҙһжҠҘе‘Ҡ пјҢ еҚҮзә§ж“ҚдҪңзі»з»ҹжҲ–Dockerзҡ„зүҲжң¬ пјҢ ж №жҚ®е®үе…ЁжҢҮеј•й…ҚзҪ®е®№еҷЁзҺҜеўғ пјҢ еҗҢж—¶еҸҜд»ҘеҸӮиҖғд»ҘдёӢжҺӘж–Ҫеўһејәе®№еҷЁйӣҶзҫӨзҡ„е®үе…ЁйҳІжҠӨзә§еҲ« гҖӮ

- еңЁзү©зҗҶеұӮйқўдёҠйҡ”зҰ» пјҢ дёәдёҚеҗҢзҡ„з§ҹжҲ·д№Ӣй—ҙеҲ’еҲҶдёҚеҗҢзҡ„Hardware Isolationеҹҹ пјҢ и®©дёҚеҗҢзҡ„з§ҹжҲ·дҪҝз”ЁдёҚеҗҢзҡ„硬件з©әй—ҙ пјҢ д»Һзү©зҗҶдёҠгҖҒзҪ‘з»ңдёҠд»ҘеҸҠеӯҳеӮЁдёҠеҪ»еә•зҡ„йҡ”зҰ» пјҢ иҝҷд№ҹжҳҜжңҖзӣҙжҺҘжңҖжңүж•Ҳзҡ„ж–№жі• гҖӮ

- еҲ©з”ЁдёҖдәӣSecurity Tools пјҢ еҢ…жӢ¬з»Ҹеёёз”Ёзҡ„SElinuxжҲ–иҖ…Cgroupйҡ”зҰ» пјҢ еҲ’еҲҶдёҚеҗҢзҡ„иө„жәҗи®ҝй—®е’Ңе®ү全规еҲҷ пјҢ дҪҶжҳҜиҝҷдәӣе®ү全规еҲҷйңҖиҰҒзј–еҶҷеӨ§йҮҸзҡ„profileж–Ү件 пјҢ е®һзҺ°иө·жқҘйҡҫеәҰйўҮеӨ§ гҖӮ

- е…ҘдҫөжЈҖжөӢжңәеҲ¶ пјҢ дё»жңәйҳІеҫЎзҡ„дёҖз§ҚжүӢж®ө гҖӮ е…ҘдҫөжЈҖжөӢзҡ„иҪҜ件жҲ–иҖ…иҝӣзЁӢдјҡзӣ‘жҺ§иҝҷеҸ°дё»жңәдёҠжңүйЈҺйҷ©зҡ„иҝӣзЁӢжҲ–иҖ…жңүйЈҺйҷ©зҡ„ж–Ү件 пјҢ еҜ№дәҺиҝҷдәӣж–Ү件зҡ„иҜ»еҶҷж“ҚдҪңйғҪдјҡжңүе®үе…Ёж–№йқўзҡ„и®°еҪ• пјҢ дјҡеҚіж—¶йў„иӯҰ пјҢ еҚіж—¶е“Қеә” гҖӮ жҜ”еҰӮеҜ№дәҺcontainerd-shim/busybox/docker-runcзҡ„е…ій”®иҝӣзЁӢ пјҢ жҜ”еҰӮdocker-runcеҜ№дәҺbashгҖҒinitжҲ–иҖ…еҜ№дәҺfdзҡ„и®ҝй—®йғҪеҸҜд»ҘеҒҡеҲ°еҚіж—¶зҡ„йў„иӯҰе’Ңж Үи®° гҖӮ еҜ№дәҺдёҠйқўжҸҗеҲ°зҡ„е®№еҷЁйҖғзҰ»жјҸжҙһ пјҢ йҖҡиҝҮе…ҘдҫөжЈҖжөӢзҡ„жңәеҲ¶ пјҢ е°ұеҸҜд»ҘжңүдёҖдёӘжҜ”иҫғжңүж•Ҳзҡ„йҳІеҫЎ гҖӮ

- е®ҡеҲ¶Linux Kernel Patch пјҢ дёҖдәӣзү№ж®Ҡзҡ„иө„жәҗйҡ”зҰ»жҲ–иҖ…е®үе…ЁжјҸжҙһ пјҢ д№ҹеҸҜд»Ҙдёәkernelжү“дёҖдәӣиҮӘиә«зү№жңүзҡ„patchжқҘеҠ д»ҘйҳІиҢғ пјҢ дҪҶжҳҜиҝҷйҮҢзҡ„patchйқўдёҙзҡ„й—®йўҳжҳҜеӨҡз§ҚеӨҡж ·зҡ„ пјҢ жүҖд»ҘиҝҷйҮҢе°ұдёҚеҶҚеұ•ејҖз»Ҷи®ІдәҶ гҖӮ

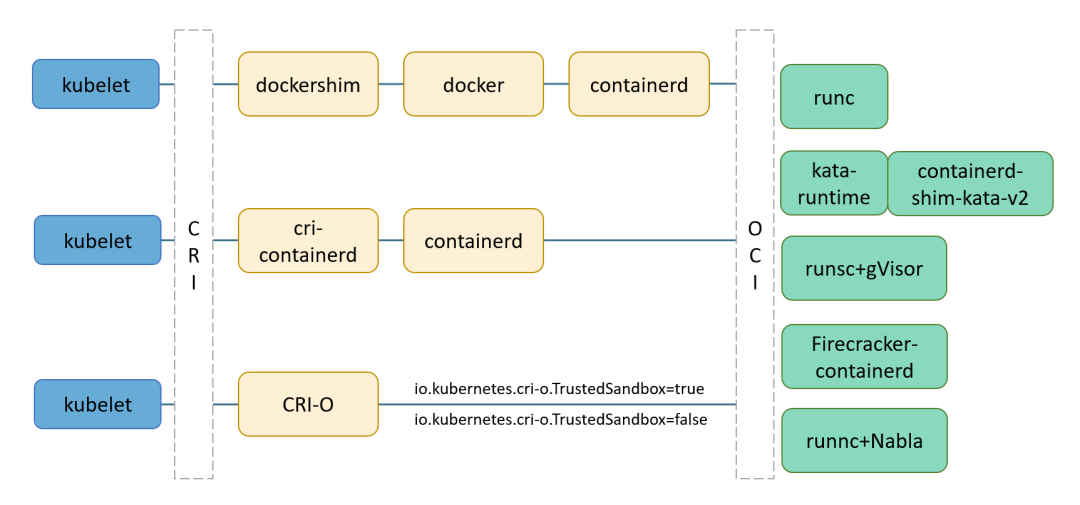

з®ҖеҚ•жўізҗҶдёҖдёӢиҝҷдәӣи§ЈеҶіж–№жЎҲ пјҢ йғҪжҳҜжҢүз…§дёӨеӨ§ж ҮеҮҶеҲ’еҲҶзҡ„ гҖӮ дёҖдёӘе°ұжҳҜCRIзҡ„ж ҮеҮҶ пјҢ еҒҸеҗ‘дәҺkubeletжҲ–иҖ…KubernetesиҝҷдёҖдҫ§зҡ„ж ҮеҮҶ гҖӮ иҝҳжңүдёҖдҫ§зҡ„ж ҮеҮҶе°ұжҳҜOCI пјҢ е°ұжҳҜеҒҸеҗ‘дәҺе®№еҷЁеә•еұӮеҹәзЎҖе®һзҺ° гҖӮ

еҸҜд»ҘзңӢеҲ°OCIиҝҷиҫ№жңүеҫҲеӨҡз§Қе®һзҺ°ж–№жЎҲ пјҢ з®ҖеҚ•жўізҗҶдёҖдёӢ пјҢ еҲ’еҲҶдәҶдёҖдёӘиЎЁж јпјҡ

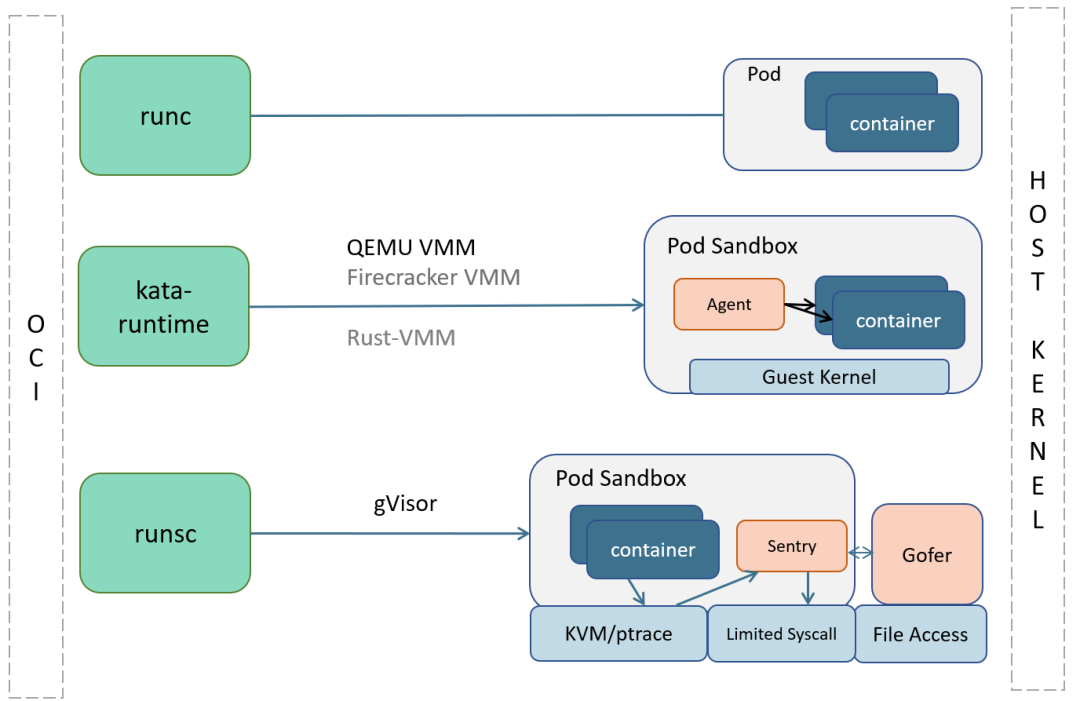

з®ҖеҚ•д»Ӣз»ҚдёҖдёӢ пјҢ жҜ”еҰӮжңүrunCзҡ„ж–№жЎҲ пјҢ е°ұжҳҜеҹәдәҺеҺҹз”ҹnamespaceзҡ„е®№еҷЁж–№жЎҲ пјҢ DockerдҪҝз”Ёзҡ„ пјҢ containerdзӣҙжҺҘеҜ№жҺҘзҡ„runcзҡ„ж–№жЎҲ гҖӮ gVisorжҳҜи°·жӯҢејҖжәҗеҮәжқҘзҡ„дёҖз§ҚеҹәдәҺз”ЁжҲ·жҖҒзҡ„еҶ…ж ёиҝӣзЁӢзҡ„е®үе…ЁжІҷз®ұжҠҖжңҜзҡ„ж–№жЎҲ гҖӮ Kataе’ҢQemuзҡ„еҹәдәҺиҷҡжӢҹеҢ–е®һзҺ°е®үе…Ёе®№еҷЁ пјҢ иҝҷдёӘзҺ°еңЁд№ҹжҳҜжҜ”иҫғзғӯй—Ё пјҢ дҪҝз”ЁжҜ”иҫғе№ҝжіӣзҡ„дёҖз§Қж–№жЎҲ гҖӮ Firecracker пјҢ з”ұAWSејҖжәҗеҮәжқҘзҡ„ пјҢ Firecracker ContainerdжҳҜеҜ№жҺҘOCIж ҮеҮҶзҡ„组件 пјҢ дҪҶзҺ°еңЁиҝҳжІЎжңүе®Ңе…ЁеҜ№жҺҘOCIж ҮеҮҶ пјҢ жүҖд»ҘиҝҷйҮҢжҳҜжңүжүҖж¬ зјәзҡ„ гҖӮ жңҖеҗҺжҳҜNabla пјҢ runnCжҳҜNablaеҜ№жҺҘOCIе®һзҺ°зҡ„дёҖдёӘ组件 пјҢ NablaжҳҜIBMејҖжәҗзҡ„дёҖеҘ—е®үе…Ёе®№еҷЁзҡ„ж–№жЎҲ пјҢ дҪҶжҳҜе®ғи·ҹдёҠиҝ°зҡ„дёҖдәӣж–№жЎҲжңүжүҖеҢәеҲ« пјҢ е®ғжҳҜдёҖдёӘеҹәдәҺunikernelзҡ„ж–№жЎҲ пјҢ жҠҠдёҡеҠЎеә”з”Ёе’ҢеҶ…ж ёе®Ңе…Ёзј–иҜ‘еңЁдәҶдёҖиө· пјҢ зӣҙжҺҘиҝҗиЎҢеңЁhostдёҠйқў пјҢ жүҖд»ҘеҸҜд»ҘзңӢеҲ°е®ғи·ҹе…¶д»–зҡ„ж–№жЎҲдёҚдёҖж ·зҡ„е°ұжҳҜе®ғдёҚиғҪзӣҙжҺҘдҪҝз”Ёе®№еҷЁзҡ„й•ңеғҸ пјҢ йңҖиҰҒиҮӘе·ұзј–иҜ‘дёҖдёӘеёҰзқҖеҶ…ж ёзҡ„зү№ж®Ҡй•ңеғҸ пјҢ жүҖд»Ҙз”Ёиө·жқҘдёҚеӨӘз¬ҰеҗҲе®№еҷЁзҡ„ж ҮеҮҶ гҖӮ

жҜ”иҫғдёӢжқҘ пјҢ е…ёеһӢзҡ„дёүз§Қе®үе…Ёе®№еҷЁж–№жЎҲе°ұжҳҜrunC пјҢ kata-runtime пјҢ д»ҘеҸҠ gVisor ж–№жЎҲ гҖӮ

дёүз§Қж–№жЎҲеҗ„жңүдјҳзјәзӮ№ пјҢ д»Һжһ¶жһ„жқҘиҜҙ пјҢ runCзҡ„ж–№жЎҲжңҖз®ҖеҚ• пјҢ зӣҙжҺҘз”ЁеҺҹз”ҹзҡ„namespaceзҡ„ж–№жЎҲ гҖӮ KataжҳҜеҹәдәҺhypervisorзҡ„ж–№жЎҲ пјҢ е°ұжҳҜеҹәдәҺиҷҡжӢҹеҢ–зҡ„ж–№жЎҲ пјҢ жүҖд»Ҙе®ғзҡ„жҜҸдёҖдёӘе®№еҷЁжҲ–иҖ…е®ғзҡ„е®№еҷЁжҳҜиҝҗиЎҢеңЁдёҖдёӘдёҖдёӘguest kernelдёҠйқў пјҢ е°ұжҳҜguestзҡ„иҷҡжӢҹжңәйҮҢ пјҢ 然еҗҺдјҡжңүдёҖдёӘkata agentиҙҹиҙЈruntimeи·ҹеә•еұӮзңҹжӯЈи·‘зҡ„containerзҡ„иҝӣиЎҢйҖҡдҝЎ гҖӮ gVisorжҳҜд»ӢдәҺruncе’Ңkata runtimeд№Ӣй—ҙ пјҢ е®ғдёҚеғҸKataжңүдёҖдёӘиҷҡжӢҹеҢ–зҡ„Guest Kernelзҡ„еӯҳеңЁ пјҢ е®ғжҳҜжҠҠGuest KernelеҸҳжҲҗдәҶдёҖдёӘиҝҗиЎҢдәҺз”ЁжҲ·жҖҒзҡ„дёҖдёӘеҶ…ж ёзҡ„иҝӣзЁӢеҸ«еҒҡSentry пјҢ GoferжҳҜе®ғIOзҡ„组件 пјҢ ж ёеҝғзҡ„sentryиҙҹиҙЈзҡ„е°ұжҳҜжӢҰжҲӘе’ҢеҠ«жҢҒжүҖжңүиҝҗиЎҢеңЁе®ғзҡ„жІҷз®ұйҮҢйқўе®№еҷЁзҡ„жүҖжңүзҡ„Syscall пјҢ еҜ№зі»з»ҹи°ғз”ЁиҝӣиЎҢиҝҮж»Өе’ҢдҝқжҠӨ гҖӮ

жңҖеҗҺжұҮжҖ»жҜ”иҫғдёҖдёӢ пјҢ runCзҡ„ж–№жЎҲе®һзҺ°жңҖз®ҖеҚ• пјҢ иҖҢдё”е®ғзҡ„жҖ§иғҪд№ҹжҳҜжңҖеҘҪзҡ„ гҖӮ дҪҶжҳҜдёҖеӨ§зјәзӮ№е°ұжҳҜе®үе…Ёйҡ”зҰ»зҡ„зү№жҖ§дёҚеӨҹе®үе…Ё пјҢ жүҖд»ҘйңҖиҰҒеӨ§йҮҸзҡ„еӨ–йғЁSecurity Toolsзҡ„дҝқжҠӨ гҖӮ еҹәдәҺkataзҡ„иҷҡжӢҹеҢ–зҡ„жІҷз®ұж–№жЎҲ пјҢ е®ғеҸӘиғҪиҝҗиЎҢеңЁж”ҜжҢҒKVMиҷҡжӢҹеҢ–зҡ„зҺҜеўғдёҠйқў пјҢ еӣ дёәд»–зҡ„иҷҡжӢҹеұӮжҳҜеҹәдәҺKVMе®һзҺ°зҡ„ гҖӮ Kataзҡ„йҖ»иҫ‘зҡ„й“ҫи·ҜеҫҲй•ҝ пјҢ и°ғз”Ёзҡ„и·Ҝеҫ„д№ҹйқһеёёй•ҝ пјҢ дјҡйҖ жҲҗдёҖдәӣжҖ§иғҪдёҠзҡ„жҚҹиҖ— пјҢ д№ҹдјҡжңүдёҖдәӣй—®йўҳ гҖӮ gVisorд»ӢдәҺдёӨиҖ…д№Ӣй—ҙ пјҢ дҪҶжҳҜgVisorзҺ°еңЁзҡ„й—®йўҳе°ұжҳҜе®ғзҡ„е…је®№жҖ§дёҚеӨҹ пјҢ 300еӨҡдёӘзі»з»ҹи°ғз”ЁеҸӘиғҪе…је®№йҮҢйқўзҡ„дёҖйғЁеҲҶ пјҢ 并且Sentryзҡ„дҪңдёәж ёеҝғдјҡжңүдёҖдәӣжҖ§иғҪ瓶йўҲ гҖӮ

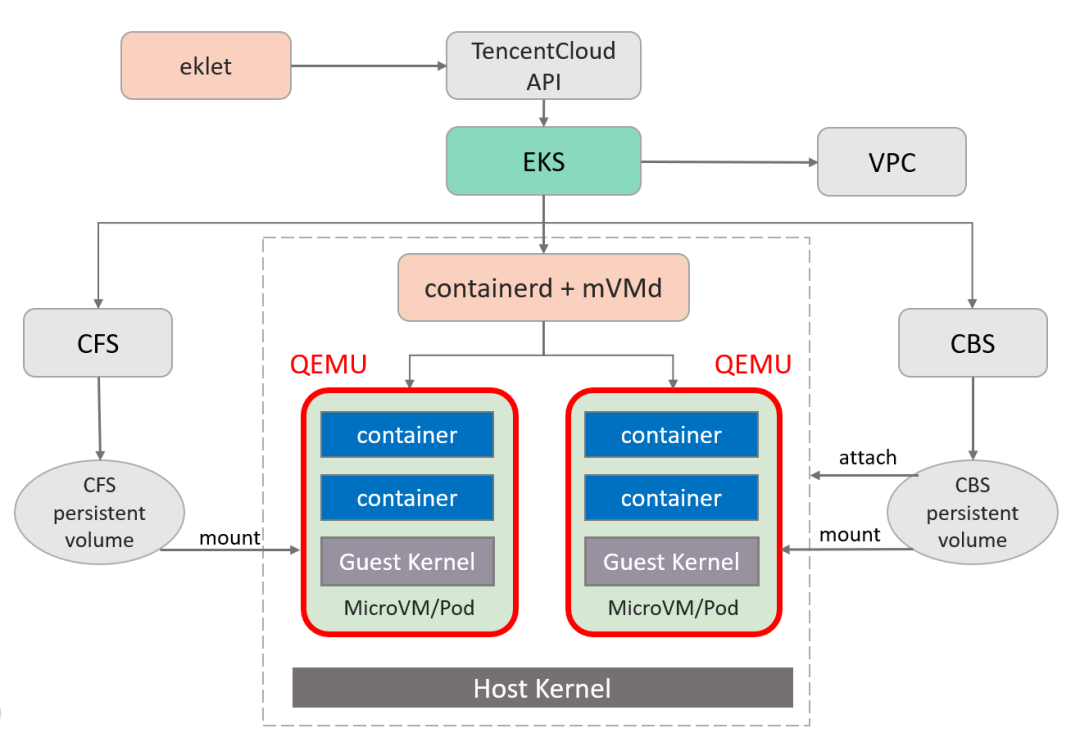

и…ҫи®Ҝдә‘еңЁе®үе…Ёе®№еҷЁдёҠиһҚеҗҲе’ҢдёҠиҝ°ж–№жЎҲзҡ„дјҳзӮ№ пјҢ з»“еҗҲи…ҫи®Ҝдә‘еңЁиҷҡжӢҹеҢ– пјҢ еӯҳеӮЁе’ҢзҪ‘з»ңж–№йқўзҡ„дјҳеҠҝ пјҢйҖүжӢ©дҪҝз”ЁmVMd + QEMU + EKLETзҡ„ж–№жЎҲ пјҢ е®һзҺ°дёҖдёӘеј№жҖ§зҡ„Kubernetesзҡ„жңҚеҠЎ пјҢ еҚіEKS пјҢ еӨ§е®¶еҸҜд»Ҙи®ҝй—®дёҖдёӢи…ҫи®Ҝдә‘зҡ„е®ҳзҪ‘ пјҢ зңӢдёҖдёӢEKSзҡ„д»Ӣз»Қ гҖӮ

EKSжҳҜеҹәдәҺHypervisorзҡ„иҷҡжӢҹеҢ–зҡ„и§ЈеҶіж–№жЎҲ пјҢ дёҚеҗҢдәҺKata пјҢ EKSдҪҝз”Ёзҡ„containerd + mVMd组件жӣҙеҠ иҪ»йҮҸ пјҢ и°ғз”Ёи·Ҝеҫ„жӣҙзҹӯ гҖӮ йҖҡиҝҮcontainrtd + mVMdжқҘе®һзҺ°еҜ№дәҺдёҠеұӮKubernetesи°ғз”Ёзҡ„CRIзҡ„и§Јжһҗ пјҢ 并且жҠҠе®ғиҪ¬еҢ–жҲҗзңҹжӯЈеҜ№дәҺеә•еұӮдёҖдёӘдёҖдёӘGuest VMжҲ–иҖ…QEMUзҡ„жҺ§еҲ¶жҢҮд»Ө пјҢ еңЁguest VMйҮҢдјҡеҗҜеҠЁзӣёеә”зҡ„containersе®№еҷЁ гҖӮ

еңЁж•ҙдёӘзҡ„жһ¶жһ„дёӯ пјҢ еңЁRuntimeж–№йқўжңҖеӨ§зҡ„瓶йўҲжҳҜQEMU пјҢ еӣ дёәQEMUжңүеҮ еҚҒе№ҙзҡ„еҺҶеҸІдәҶ пјҢ жүҖд»ҘеӯҳеңЁзқҖе®ғжҜ”иҫғиҮғиӮҝ пјҢ еҸҚеә”ж…ў пјҢ еҚ з”Ёзҡ„иө„жәҗеӨҡзӯүзӯүй—®йўҳ гҖӮ жүҖд»Ҙи®©QEMUдҪңдёәеә•еұӮRuntimeиҝҳдёҚеӨҹеҝ« пјҢ дёҚеӨҹе®үе…Ё гҖӮ дёәдәҶеўһејәQEMUзҡ„жҖ§иғҪе’Ңе®үе…Ёзү№жҖ§ пјҢ жҲ‘们еҫҲиҮӘ然жҠҠзңје…үжҠ•еҗ‘дәҶRust-Vmm гҖӮ

Rust-Vmm д»Ӣз»ҚRust-VmmжҳҜдёҖдёӘејҖжәҗе·ҘзЁӢ пјҢ жҳҜдёҖдёӘеҸҜд»ҘиҮӘз”ұе®ҡеҲ¶зҡ„VMMпјҲvirtual machine monitorпјүиҷҡжӢҹжңәз®ЎзҗҶеҷЁ пјҢ з”ЁжҲ·еҸҜд»ҘжҢүз…§иҮӘе·ұзҡ„ж–№ејҸи®ўеҲ¶е®ғ гҖӮ е®ғжҳҜеҹәдәҺRustиҜӯиЁҖе®һзҺ°зҡ„VMM пјҢ жңүзқҖRustиҜӯиЁҖеёҰжқҘзҡ„дјҳзӮ№е’Ңзү№жҖ§ гҖӮ

йҰ–е…Ҳ пјҢ RustиҜӯиЁҖдёҖдёӘеҶ…еӯҳе®үе…Ёзҡ„иҜӯиЁҖ пјҢ зӣёжҜ”дәҺз”ЁCжҲ–иҖ…C++дјҡйў‘з№ҒйҒҮеҲ°зҡ„еҗ„з§ҚеҶ…еӯҳзҡ„й—®йўҳ пјҢ жҜ”еҰӮеҶ…еӯҳзҡ„жәўеҮәгҖҒз©әжҢҮй’ҲгҖҒйҮҺжҢҮй’ҲгҖҒи¶Ҡз•Ңи®ҝй—®зӯүзӯү пјҢ жӣҙиҝӣдёҖжӯҘдјҡйҖ жҲҗе®үе…Ёзҡ„й—®йўҳгҖҒжҖ§иғҪзҡ„й—®йўҳ пјҢ д»ҘеҸҠеҗ„з§Қеҙ©жәғзҡ„й—®йўҳ гҖӮ RustиҜӯиЁҖеҫҲеҘҪең°и§ЈеҶідәҶиҝҷдёҖзӮ№ пјҢ д»Һе®ғзҡ„иҜӯжі•гҖҒзј–иҜ‘规еҲҷзӯүжқңз»қдәҶеҶ…еӯҳзә§еҲ«и®ҝй—®зҡ„жјҸжҙһд»ҘеҸҠйЈҺйҷ© пјҢ жүҖд»Ҙз”ЁRustеҶҷзҡ„Rust-VmmеӨ©з„¶зҡ„е°ұжҳҜеҶ…еӯҳе®үе…Ёзҡ„ гҖӮ

第дәҢ пјҢ Rust-VmmжҳҜдёҚжҳ“иў«ж”»еҮ»зҡ„ пјҢ Rust-VMMжҳҜд»Һйӣ¶ејҖе§Ӣзҡ„ пјҢ е®ғжҳҜд»ҺжңҖе°Ҹзҡ„硬件иҷҡжӢҹеҢ–еҮәеҸ‘зҡ„ пјҢ жңҖе°Ҹзҡ„硬件иҷҡжӢҹеҢ–ж„Ҹе‘ізқҖе®ғжңүзқҖжңҖе°Ҹзҡ„ж”»еҮ»йқў пјҢ иў«ж”»еҮ»зҡ„йқўе°ұйқһеёёе°‘ пјҢ жүҖд»Ҙе®ғдјҡеҫҲе®үе…Ё гҖӮ

第дёү пјҢ Rust-VmmиғҪеӨҹеҫҲзҒөжҙ»зҡ„е®ҡеҲ¶ гҖӮ Rust-VMMеҸҜд»ҘзҒөжҙ»е®ҡеҲ¶е®ғзҡ„жҜҸдёҖдёӘ组件 пјҢ жүҖжңүзҡ„еҜ№дәҺи®ҫеӨҮзҡ„жЁЎжӢҹжҲ–иҖ…е…ій”®зү№жҖ§зҡ„еӨ„зҗҶйғҪжҳҜе°ҒиЈ…жҲҗдәҶдёҖдёӘдёҖдёӘзҡ„Rust-Vmm cratesеҢ… пјҢ жҜ”еҰӮжңүVCPU пјҢ жңүlinuxloader пјҢ vm-virtIOзӯүзӯү гҖӮ е…¶дёӯcratesжҳҜRustиҜӯиЁҖдёӯзҡ„еҢ…з®ЎзҗҶе·Ҙе…· пјҢ еҸҜд»ҘзҗҶи§ЈJAVAжҲ–golangйҮҢйқўзҡ„package пјҢ е®ғжҳҜд»ҘеҸ‘иЎҢдёҚеҗҢзҡ„еҢ…жҲ–иҖ…еә“зҡ„еҪўејҸеҜ№еӨ–еҸ‘еёғе®ғзҡ„feature гҖӮ

第еӣӣ пјҢ Rust-Vmmжңүйқһеёёй«ҳзҡ„жҖ§иғҪ пјҢ еҹәдәҺRustиҜӯиЁҖзҡ„without garbage collectionзү№жҖ§ пјҢ е®ғжҳҜжІЎжңүGCеӣһ收жЈҖжҹҘжңәеҲ¶зҡ„ пјҢ дёҚеғҸJAVAжҲ–иҖ…е…¶д»–жӣҙй«ҳзә§зҡ„иҜӯиЁҖдјҡжңүдёҖдёӘruntime пјҢ Rust-Vmmзҡ„жҖ§иғҪдёҠдјҡжӣҙеҘҪ пјҢ еҗҢж—¶еҹәдәҺKVMе®һзҺ°зҡ„иҷҡжӢҹеҢ–ж–№жЎҲд№ҹжҳҜжҖ§иғҪзҡ„дҝқиҜҒ гҖӮ

з®ҖеҚ•д»Ӣз»ҚдёҖдёӢRust-Vmmзҡ„дёҖдёӘеҺҶеҸІ пјҢ е®ғжҳҜз”ұи°·жӯҢйҰ–е…Ҳе®һзҺ°зҡ„ пјҢ и°·жӯҢйҰ–е…Ҳе®һзҺ°дёҖдёӘRust basedзҡ„иҪ»йҮҸзә§зҡ„VMM пјҢ е®ғеҸ«еҒҡcrosVM пјҢ еӨ§е®¶д№ҹеҸҜд»Ҙд»Һй“ҫжҺҘйҮҢйқўзңӢеҲ° пјҢ е®ғжҳҜдёҖдёӘдёәchromeжөҸи§ҲеҷЁеҒҡзҡ„дёҖдёӘеҫ®еҶ…ж ё гҖӮ 然еҗҺAWS пјҢ дәҡ马йҖҠеҹәдәҺи°·жӯҢејҖжәҗеҮәжқҘзҡ„crosVM пјҢ е®һзҺ°дәҶиҮӘе·ұзҡ„еҹәдәҺrustзҡ„VMMеҸ«Firecracker гҖӮ дёӨдёӘйЎ№зӣ®зҡ„ејҖеҸ‘дәәе‘ҳдјҡеҸ‘зҺ°еҒҡиҝҷдёӨдёӘйЎ№зӣ®зҡ„ж—¶еҖҷ пјҢ дјҡжңүеҫҲеӨҡйҮҚеӨҚзҡ„йҮҚеҸ зҡ„йҖҡз”Ёзҡ„д»Јз Ғ пјҢ еҫҲиҮӘ然зҡ„жҠҠеҸҜд»ҘејҖжәҗзҡ„гҖҒйҖҡз”Ёзҡ„йғЁеҲҶз»“еҗҲеҲ°дёҖеқ— пјҢ е°ұжңүдәҶRust-Vmmзҡ„йЎ№зӣ® гҖӮ

д»ҺиҝҷдёӘе…ЁжҷҜеӣҫйҮҢйқўеҸҜд»ҘзңӢеҲ° пјҢ Rust-Vmmеә”з”ЁеңЁеӨҡдёӘйЎ№зӣ®е’Ңдә§е“Ғдёӯ гҖӮ д»ҺжңҖејҖе§Ӣзҡ„и°·жӯҢејҖжәҗзҡ„crosVMйҮҢйқўдјҡжңүRust-Vmm пјҢ жҜ”еҰӮAWSзҡ„FirecrackerгҖҒд»ҘеҸҠе…¶е®ғCSPдә‘жңҚеҠЎеҷЁеҺӮе•Ҷ пјҢ жҜ”еҰӮQEMUйҮҢйқўдјҡжҠҠдёҖдәӣиҖ—ж—¶зҡ„жҲ–иҖ…еҶ…еӯҳи®ҝй—®зҡ„йғЁеҲҶд№ҹз”ЁRust-Vmmе®һзҺ° пјҢ иҝҳжңүејҖжәҗзҡ„Cloud HypervisorйЎ№зӣ® гҖӮ

Cloud HypervisorжҳҜIntelејҖжәҗеҮәжқҘзҡ„дёҖеҘ—жЎҶжһ¶ пјҢ жҠҠRust-Vmmзҡ„组件组еҗҲеңЁдёҖиө· пјҢ иғҪеӨҹеҜ№еӨ–жҸҗдҫӣдёҖдёӘVMMзҡ„е®Ңж•ҙжңҚеҠЎ гҖӮ з”ЁжҲ·еҸҜд»Ҙй…ҚзҪ®дҪҝз”Ёе·Іе…¬ејҖеҸ‘еёғзҡ„cratesеҢ… пјҢ жҲ–йӣҶжҲҗиҮӘе·ұзҡ„ејҖеҸ‘зҡ„cratesеҢ… пјҢ йҖҡиҝҮе°Ҷеҗ„з§ҚcratesеҢ…з»„еҗҲеңЁдёҖиө· пјҢ е°ұеҸҜд»Ҙз”ҹжҲҗдёҖдёӘи®ўеҲ¶зҡ„е®үе…Ёзҡ„й«ҳжҖ§иғҪзҡ„VMM гҖӮ

еҹәдәҺ Rust-Vmm е®һзҺ° Kubernetes Runtimeи®ІеҲ°иҝҷйҮҢ пјҢ еҹәдәҺRust-VMMзҡ„дёҖдёӘе®һзҺ° пјҢ 组件гҖҒеҺҹж–ҷе’ҢжүҖжңүзҡ„зҹҘиҜҶйғҪе·Із»Ҹе…·еӨҮдәҶ пјҢ жҺҘдёӢжқҘе°ұжҳҜеҰӮдҪ•еҜ№жҺҘKubernetes пјҢ еҹәдәҺRust-VMMе®һзҺ°Kubernetes runtime пјҢ иҝҗиЎҢдёҖдёӘKubernetesзҡ„Pod гҖӮ

жөӢиҜ•зҺҜеўғеҰӮеӣҫжүҖзӨә пјҢ з”ЁеҲ°дәҶеҢ…жӢ¬Kubernetes пјҢ containerd пјҢ Kata пјҢ Rust-Vmm пјҢ Cloud HypervisorзӯүејҖжәҗйЎ№зӣ® пјҢ йҰ–е…ҲжҲ‘们й…ҚзҪ®KubernetesиҠӮзӮ№дёҠзҡ„kubeletдҪҝз”Ёзҡ„runtimeдёәcontainerd пјҢ еңЁcontainerdдёҠй…ҚзҪ®дәҶKata-runtimeдҪңдёәе®№еҷЁзҡ„иҝҗиЎҢж—¶ пјҢ еҶҚй…ҚзҪ®дәҶKata-runtimeдҪҝз”Ёзҡ„vmmдёәеҹәдәҺRust-Vmm cratesжһ„е»әзҡ„Cloud Hypervisor пјҢ еҗҢж—¶дёәдәҶжҸҗеҚҮжҖ§иғҪ пјҢ иҝҷйҮҢд№ҹжҳҜз”ЁдәҶvirtos-fsжҠҖжңҜжқҘжүҝиҪҪзү©зҗҶжңәдёҠзҡ„е®№еҷЁй•ңеғҸеҲ°еӯҗжңәеҶ…е®№еҷЁзҡ„imagefsзҡ„е…ұдә« пјҢ жүҖд»ҘеңЁзү©зҗҶжңәдёҠйңҖиҰҒйўқеӨ–ејҖеҗҜvirtiofsdзҡ„иҝӣзЁӢ пјҢ еңЁguest osзҡ„еҶ…ж ёдёҠд№ҹжҳҜдҪҝз”ЁжңҖж–°зҡ„еҢ…еҗ«virtio-fsж”ҜжҢҒзҡ„еҶ…ж ёзүҲжң¬ гҖӮ

еңЁKubernetesдёҠеҲӣе»әдёҖдёӘPodеҗҺ пјҢ и°ғеәҰеҷЁи°ғеәҰиҝҷдёӘPodеҲ°жҲ‘们иҝҷдёӘзҺҜеўғдёҠзҡ„дёҖдёӘworkerиҠӮзӮ№ пјҢ иҠӮзӮ№дёҠзҡ„kubeletиҝӣзЁӢж №жҚ®жҲ‘们зҡ„й…ҚзҪ®и°ғз”Ёcontainerd пјҢ containerdзҡ„runtimeжҸ’件kataжқҘеҲӣе»әCloud Hypervisorзҡ„vmmпјҲvirtual machine monitorпјү пјҢ еңЁеӯҗжңәеҶ…йў„зҪ®зҡ„Guest OSж“ҚдҪңзі»з»ҹеҗҜеҠЁеҗҺ пјҢ kata-agentд№ҹйҡҸд№ӢеҗҜеҠЁ пјҢ жҲҗеҠҹе»әз«ӢжҜҚжңәдёҺеӯҗжңәзҡ„йҖҡйҒ“ пјҢ еҗҺз»ӯcriеҚҸи®®дёӯзҡ„createcontainer пјҢ startcontainerд»ҘеҸҠеҒңжӯўе®№еҷЁзӯүжҺҘеҸЈд№ҹз”ұиҝҷдёӘйҖҡйҒ“дј йҖ’еҲ°еӯҗжңәеҶ…зҡ„kata-agent пјҢ з”ұе…¶жқҘи°ғз”ЁеӯҗжңәеҶ…зңҹжӯЈзҡ„е®№еҷЁиҝҗиЎҢж—¶ пјҢ д»ҺиҖҢе®ҢжҲҗж•ҙдёӘPodзҡ„з”ҹе‘Ҫе‘Ёжңҹ гҖӮ

жҲ‘们жқҘзңӢдёҖдёӢжңҖз»ҲиҫҫеҲ°зҡ„ж•Ҳжһң пјҢ еҰӮеӣҫдёӯ第дёҖжқЎжҢҮд»Ө пјҢ жҲ‘们жү§иЎҢkubectl get podе‘Ҫд»ӨеҸҜд»ҘзңӢеҲ°podзҡ„зҠ¶жҖҒдёәиҝҗиЎҢдёӯ гҖӮ еҗҢж ·зҡ„ пјҢ жҲ‘们д№ҹеҸҜд»ҘйҖҡиҝҮcrictl podsе‘Ҫд»ӨжҹҘиҜўеҲ°иҝҷдёӘPodзҡ„зҠ¶жҖҒ гҖӮ йҖҡиҝҮpsжҹҘиҜўиҝӣзЁӢеҲ—иЎЁ пјҢ еҸҜд»ҘзңӢеҲ°еҢ…еҗ«иҝҷдёӘpod idзҡ„kata shimиҝӣзЁӢ пјҢ virtiofsdиҝӣзЁӢд»ҘеҸҠcloud-hypervisorиҝҷдёӘvmmзҡ„иҝӣзЁӢ гҖӮ жңҖеҗҺжҲ‘们д№ҹеҸҜд»ҘйҖҡиҝҮkubectl exec -itдәӨдә’ејҸзҡ„иҝӣе…Ҙpodзҡ„containerеҶ… пјҢ йҖҡиҝҮunameиҝ”еӣһжӯӨе®№еҷЁдҪҝз”Ёзҡ„еҶ…ж ёзүҲжң¬дёә5.6 пјҢ зү©зҗҶжңәзҡ„еҶ…ж ёзүҲжң¬дёә5.4 гҖӮ

жҖ»з»“дёҺеұ•жңӣгҖҗkubernetes|еҹәдәҺRust-vmmе®һзҺ°KubernetesиҝҗиЎҢж—¶гҖ‘жңҖеҗҺжҳҜеҜ№жңӘжқҘзҡ„еұ•жңӣ пјҢ еҹәдәҺRust-VmmжҲ‘们жғіиҰҒеҒҡеҫ—жӣҙеӨҡ гҖӮ жҜ”еҰӮеёҢжңӣжү©еұ•дёҖдёӢRust-VmmеңЁзҪ‘з»ңд»ҘеҸҠеӯҳеӮЁж–№йқўзҡ„дёҖдәӣзү№жҖ§ пјҢ е°Өе…¶жҳҜеңЁи…ҫи®Ҝдә‘зҡ„зҺҜеўғйҮҢйқў пјҢ йҖҡиҝҮз»“еҗҲCBSе’ҢVPC пјҢ жҸҗеҚҮRuntimeзҡ„жҖ§иғҪ гҖӮ

第дәҢ пјҢ дјҡз»“еҗҲе…ҘдҫөжЈҖжөӢгҖҒдё»жңәе®үе…ЁгҖҒе®үе…Ёе·Ҙе…·зӯү пјҢ жҠҠе®ғ们иһҚеҗҲеңЁдёҖиө· пјҢ жһ„е»әиө·дёҖдёӘеӨҡз»ҙзҡ„гҖҒеӨҡйҮҚйҳІжҠӨзҡ„дёҖеҘ—е…Ёз»ҙеәҰе®үе…Ёзҡ„е®№еҷЁжңҚеҠЎе№іеҸ° пјҢ Rust-VMMдјҡе®һзҺ°йҮҢйқўзҡ„дёҖйғЁеҲҶ гҖӮ

第дёү пјҢ жү©еұ•Rust Runtime пјҢ е°Өе…¶еңЁиҫ№зјҳи®Ўз®—йўҶеҹҹ пјҢ еңЁиҫ№зјҳз«ҜиғҪеӨҹе®һзҺ°Kubernetesд»ҘдёӢе®Ңе…Ёз”ұRustжҺҘз®Ў пјҢ з”ұRustиҜӯиЁҖе…ЁйғЁйҮҚеҶҷ пјҢ жҜ”еҰӮеә•еұӮзҡ„ContainerdгҖҒ shimзӯү组件 пјҢ еҸҳжҲҗдёҖдёӘFull Stack Rustзҡ„е®һзҺ° гҖӮ

жңҖеҗҺ пјҢ Rust-VMMд№ҹжҳҜеҹәдәҺhypervisorжқҘе®һзҺ° пјҢ жүҖд»ҘеҹәдәҺhypervisorзҡ„дёҖдәӣзү№жҖ§ пјҢ жҜ”еҰӮзғӯиҝҒ移гҖҒеӨҮд»ҪгҖҒеӣһж»ҡиҝҷдәӣжңәеҲ¶ пјҢ жңӘжқҘжҲ‘们еёҢжңӣйғҪеҸҜд»ҘеңЁRust-VmmдёҠиҝӣиЎҢе®һзҺ° гҖӮ

жҺЁиҚҗйҳ…иҜ»

- йҮҸеӯҗй—Ё|еҲ©з”Ёи¶…еҜјйҮҸеӯҗжҜ”зү№е®һзҺ°еҹәдәҺйқһз»қзғӯеҮ дҪ•зӣёзҡ„йҮҸеӯҗй—Ё

- rnai|ж–°иҚҜйҖҹйҖ’пјҡйҰ–дёӘеҹәдәҺRNAiз–—жі•зҡ„ж–°иҚҜARC-520з»“жһңеҮәзӮүпјҒ

- 2020WNEVCеҲӣж–°жҠҖжңҜи§ЈиҜ» | еҹәдәҺжҳҮи…ҫAIзҡ„иҮӘеҠЁй©ҫ驶дә‘жңҚеҠЎжҠҖжңҜ

- жңҖж–°ж¶ҲжҒҜ|зәҰзҝ°В·дј еҘҮе’ҢеЁңеЎ”иҺүВ·жіўзү№жӣјжҠ•иө„зҡ„MycoWorksеҸҜеҲ¶йҖ еҹәдәҺзңҹиҸҢзҡ„з”ҹзү©жқҗж–ҷ

- Python дҝ„зҪ—ж–Ҝж–№еқ—пјҢ еҹәдәҺpyqt5е®һзҺ°дҝ„зҪ—ж–Ҝж–№еқ— --pyqt5 иҝӣйҳ¶

- и®Ўз®—жңәи§Ҷи§үе·ҘеқҠ|дёҖж–ҮеёҰдҪ дәҶи§ЈеҹәдәҺи§Ҷи§үзҡ„жңәеҷЁдәәжҠ“еҸ–иҮӘеӯҰд№ (Robot Learning)

- еҫ®иҪҜ|еҫ®иҪҜи®ӨдёәеҹәдәҺзҹӯдҝЎзҡ„еӨҡеӣ зҙ и®ӨиҜҒжңәеҲ¶е№¶дёҚе®үе…Ё еә”иҜҘиў«ж”ҫејғ

- жҳЁжҷҡпјҢиӢ№жһңйҮҚж–°е®ҡд№үдәҶз”өи„‘пјҒеҹәдәҺARMжһ¶жһ„зҡ„M1иҠҜзүҮд№…иҝқзҡ„macOS Big Sur旧瓶装新酒зҡ„дёүж¬ҫMacз”өи„‘

- |еҹәдәҺAndroid 11пјҡOPPO Ace2иҝҺColorOS 11жӯЈејҸзүҲеҚҮзә§

- еҢәеқ—й“ҫ|ж—Ҙжң¬Layer Xе®һйӘҢе®Өе®ЈеёғејҖеҸ‘еҹәдәҺеҢәеқ—й“ҫзҡ„з”өеӯҗжҠ•зҘЁеҚҸи®®

![[з”өз«һдёҖжқЎйҫҷ]дёәд»Җд№ҲзӢ¬и§’е…Ҫm416иғҪд»Ҙ50.4дёҮзҘЁзҷ»йЎ¶жҰңйҰ–пјҹзӯ”жЎҲи—ҸеңЁ1еј еӣҫзүҮдёӯпјҒ](https://imgcdn.toutiaoyule.com/20200410/20200410182834652952a_t.jpeg)